Scrapy中的crawlspider

- 作者: 五速梦信息网

- 时间: 2026年04月04日 13:28

补充内容:

- LinkExtractor更多常见参数:

- allow:满足括号中“正则表达式”的URL会被提取,如果为空,则全部匹配。

- deny:满足括号中“正则表达式”的URL-定不提取(优先级高于allow)。

- allow_ domains:会被提取的链接的domains.

- deny_ domains:-定不会 被提取链接的domains.

- restrict_ xpaths: 使用xpath表达式,和allow共同作用过滤链接,xpath满足 范围内的url地址会被提取

- spiders . Rule常见参数:

- link_ extractor: 是一个Link Extractor对象,用于定义需要提取的链接。

- callback:从link extractor中每获取到链接时,参数所指定的值作为回调函数

- follow:是一个布尔(boolean)值,指定了根据该规则从response提取的链接是否需要跟进。如果callback为None, fllw 默认设置为True,否则默认为False。

- process_ links:指定该spider中哪个的函数将会被调用, link_ extractor中获取到链接列表时将会调用该函数,该方法主要用来过滤url。

- process_ request: 指定该spider中哪个的函数将会被调用,该规则提取到每个request时都会调用该函数,用来过滤request.

- 上一篇: scrapy中的request

- 下一篇: scrapy中Request中常用参数

相关文章

-

scrapy中的request

scrapy中的request

- 互联网

- 2026年04月04日

-

Scrapy中的Request和Response

Scrapy中的Request和Response

- 互联网

- 2026年04月04日

-

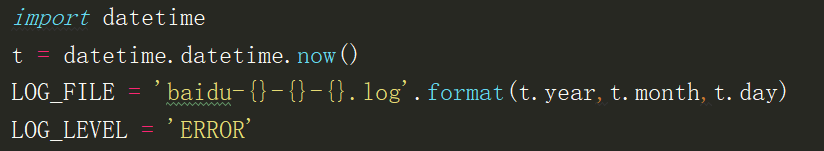

Scrapy中的Request和日志分析

Scrapy中的Request和日志分析

- 互联网

- 2026年04月04日

-

scrapy中Request中常用参数

scrapy中Request中常用参数

- 互联网

- 2026年04月04日

-

scrapy之Request对象

scrapy之Request对象

- 互联网

- 2026年04月04日

-

Scrapy数据解析和持久化

Scrapy数据解析和持久化

- 互联网

- 2026年04月04日