客户网站分析哈尔滨开发公司

- 作者: 五速梦信息网

- 时间: 2026年03月21日 10:34

当前位置: 首页 > news >正文

客户网站分析,哈尔滨开发公司,开天猫店需要什么条件多少钱,做外贸哪些国外网站可以推广一、引言 1.1 研究背景与目的 随着信息技术的飞速发展#xff0c;数据中心在现代社会中的地位日益凸显#xff0c;成为支撑各行业数字化转型的关键基础设施。在数据中心内部#xff0c;数据的处理速度、效率和安全性成为了影响整体性能的核心要素。为了应对不断增长的数据… 一、引言 1.1 研究背景与目的 随着信息技术的飞速发展数据中心在现代社会中的地位日益凸显成为支撑各行业数字化转型的关键基础设施。在数据中心内部数据的处理速度、效率和安全性成为了影响整体性能的核心要素。为了应对不断增长的数据量和日益复杂的数据处理需求数据处理器DPU应运而生并逐渐成为数据中心领域的研究热点。 DPU作为一种专用处理器专门用于处理数据中心中的数据相关任务能够显著提高数据处理效率、降低能耗并提升系统的整体性能。它的出现旨在解决传统通用处理器如CPU在处理网络、存储和安全等任务时效率低下的问题通过卸载这些任务到DPU上释放CPU的算力使其能够专注于更核心的业务逻辑处理。 1.2 DPU 的发展历程与现状 DPU的发展历程可以追溯到传统网卡时代。早期的网卡主要功能是实现计算机与网络之间的物理连接进行简单的数据传输如基本的发送和接收数据包仅具备有限的硬件卸载能力像Checksum校验和、LROLarge Receive Offload大接收卸载/LSOLarge Send Offload大发送卸载等并且支持SR-IOVSingle Root I/O Virtualization单根I/O虚拟化以及有限的多队列能力。在云平台虚拟化网络中其向虚拟机VM提供网络接入的方式主要有三种一是通过操作系统内核驱动接管网卡并向虚拟机分发网络流量二是由OVS-DPDK接管网卡并向虚拟机分发网络流量三是在高性能场景下借助SR-IOV的方式为虚拟机提供网络接入。随着云计算和数据中心的发展对网络性能和功能的要求不断提高传统网卡逐渐难以满足需求智能网卡应运而生。 智能网卡的发展经历了多个阶段。第一代智能网卡具有更丰富的硬件卸载能力例如实现了OVS Fastpath硬件卸载、基于RoCEv1和RoCEv2的RDMARemote Direct Memory Access远程直接内存访问网络硬件卸载、融合网络中无损网络能力如PFCPriority Flow Control优先级流控ECNExplicit Congestion Notification显式拥塞通知ETSEnhanced Transmission Selection增强传输选择的硬件卸载、存储领域NVMe-oFNon-Volatile Memory Express over Fabrics的硬件卸载以及安全传输的数据面卸载等这个时期主要侧重于数据平面的卸载。第二代智能网卡则在第一代的基础上加入了CPU从而能够卸载控制平面的任务以及一些灵活复杂的数据平面任务这就是DPU智能网卡。它具有一些显著特点比如支持PCIe Root Complex模式和Endpoint模式在配置为PCIe Root Complex模式时可以充当NVMe存储控制器与NVMe SSD磁盘共同构建存储服务器。 由于大规模数据中心网络对无损网络的要求愈发严格需要解决诸如数据中心网络中Incast流量多对一流量模式可能导致网络拥塞、“大象”流大流量数据传输等带来的网络拥塞和时延问题各大公有云厂商纷纷提出了自己的应对方案。例如阿里云的高精度拥塞控制HPCCHigh Precision Congestion ControlAWS的可扩展可靠数据报SRDScalable Reliable Datagram等。DPU智能网卡在处理这类问题时引入了更为先进的方法如Fungible的TrueFabric技术。此外业界还提出了将Hypervisor中的网络、存储和安全全栈卸载的发展方向以Intel为代表的IPUInfrastructure Processing Unit基础设施处理单元试图将基础设施的功能全部卸载到智能网卡中以全面释放之前用于Hypervisor管理的CPU算力。 随着功能的不断增加智能网卡的功率也逐渐增大未来可能会出现独立供电的智能网卡这需要考虑网卡状态与计算服务之间的低层信号识别以及在计算系统启动过程中或启动后智能网卡是否进入服务状态等问题还可能会出现没有PCIe接口的DPU智能网卡它们可以组成DPU资源池专门负责网络功能如负载均衡、访问控制、防火墙设备等管理软件可直接通过智能网卡管理接口定义对应的网络功能并作为虚拟化网络功能集群提供网络能力另外多PCIe接口、多网口的DPU芯片也将成为一种发展趋势例如Fungible F1芯片支持16个双模PCIe控制器可配置为Root Complex模式或Endpoint模式以及8x100G网络接口通过PCIe Gen3 x8接口能够支撑8个Dual-Socket计算服务器网络侧提供8x100G带宽的网口。 在当前市场中DPU已经成为众多厂商竞相角逐的领域各大厂商纷纷推出自己的DPU产品并具有各自的技术特点。 英伟达NVIDIA在DPU领域具有先发优势其BlueField系列芯片已发展到第三代。BlueField 2搭载8颗64 bit的ARMA72 CPU内核、2VLIM加速器和ConnectX6Dx智能网卡可提供双端口最高100Gbps和单端口200Gbps的网络连接能够快速有效地捕获、分析、分类、管理和存储海量数据实现RDMA/RoCE、DPU Direct、弹性存储、分块存储加密和恶意外部应用自动检测等功能从而实现单颗DPU芯片对125个CPU内核的释放。BlueField2X在此基础上集成了2021年5月发布的7nm级Ampere架构GPU和第三代Tensor内核可通过AI加速数据中心的安全、网络连接、数据存储等任务。此外英伟达还发布了面向开发者的平台DOCA SDK通过集成Ampere GPU和BlueField2 DPU优化EGXAI平台并向流媒体、智能驾驶、医疗等终端场景扩展。据深科技数据英伟达预计BlueField4将于2023年发布预计性能可提升600倍达到75/400TOPS400Gbps吞吐量有望较BlueField2提升600倍。 AMD在2022年以19亿美元收购Pensando后进入DPU赛道。AMD Pensando平台的核心是完全可编程P4数据处理单元(DPU)采用与超大规模服务系统相同的底层技术经过专门优化通过软件堆栈实现以云级别提供云服务、计算、网络、存储和安全服务并尽可能降低延迟、抖动和能源需求。该DPU将强大的软件堆栈与“零信任安全”和领先的可编程数据包处理器相结合打造出更为智能、性能更强的DPU。目前AMD Pensando DPU已在IBM云、微软Azure和甲骨文云等云合作伙伴中大规模部署并在企业中部署于HPE Aruba CX 10000智能交换机中与DXC等客户合作作为VMware vSphere Distributed Services Engine的一部分为客户加速应用程序性能。AMD还公布了代号为“Giglio”的下一代DPU路线图与当前一代产品相比旨在为客户带来更高的性能和能效预计于2023年底上市。 AWS是早期自研DPU的云厂商之一。2015年收购芯片厂商Annapurna Labs2017年正式推出Nitro芯片如今AWS Nitro DPU系统已成为其云服务的技术基石。AWS借助Nitro DPU系统将网络、存储、安全和监控等功能分解并转移到专用的硬件和软件上使服务器上几乎所有资源都可用于服务实例极大地降低了成本。Nitro DPU系统主要包括Nitro Hypervisor一个轻量级虚拟机监控程序仅负责管理CPU和Memory的分配几乎不占用Host资源所有服务器资源都可用于执行客户的工作负载、Nitro Cards一系列用于卸载和加速的协处理外设卡承载网络、存储、安全及管理功能大幅提升网络和存储性能并从硬件层提供天然的安全保障、Nitro Security Chip提供面向专用硬件设备及其固件的安全防护能力包括限制云平台维护人员对设备的访问权限消除人为错误操作和恶意篡改、Nitro Enclaves基于Nitro Hypervisor进一步提供创建CPU和Memory完全隔离的计算环境的能力以保护和安全地处理高度敏感的数据以及Nitro TPM可信平台模块支持TPM 2.0标准允许EC2实例生成、存储和使用密钥支持通过TPM 2.0认证机制提供实例完整性的加密验证。 国内还有一些新兴的DPU厂商也在不断崛起如星云智联、大禹智芯、云脉芯联、芯启源和中科驭数等。星云智联创立于2021年3月汇聚了来自多地ICT领域顶尖专家专注于数据中心基础互联通信架构和DPU芯片研发。其首款DPU产品NebulaX D1055AS于2021年7月发布是国内首款全硬加速、超强转发、极简运维的DPU产品聚焦云计算的裸金属、虚机、容器等场景实现网络与存储卸载与加速提升业务性能节省主机CPU简化IaaS运维可广泛用于多种云基础设施场景产品为PCIe插卡形态管控面采用通用的CPU Linux架构DPU OS上运行多种软件支持带外管理网口通过管理网络对接云平台具有良好的软件生态兼容性。大禹智芯的Paratus 2.0作为其DPU的第二条产品线产品于2022年10月发布采用ARM SoC FPGA的硬件架构在Paratus 1.0基础上利用FPGA对可固化逻辑的数据包实现高性能转发提供多个不同速率的业务网络接口具备强大的软件开放性支持VirtIO来增强虚拟化环境下的适配性能够灵活呈现大规模主机侧功能可实现多种功能卸载及为存储服务端提供数据处理服务加速还提供云管平台对接的插件、独立的BMC模块方便用户在云环境下实现业务的自动化部署、带外管理能力及与服务器更好的联动。云脉芯联在2022年5月31日正式发布自主研发的国内首款多场景RDMA智能网卡(DPU)产品——xFusion50它是国内首款实现包括支持端到端拥塞控制完整RDMA功能的DPU产品基于硬件实现的可编程拥塞控制算法能够有效避免网络拥塞充分发挥RDMA技术的低延迟和高性能支持云计算、高性能计算、AI、存储集群全场景部署还通过自主研发HyperDirect技术支持GPU Direct RDMA为跨计算节点的GPU实现远程内存直接访问跳过CPU以降低时延、提升带宽提升分布式异构算力集群的整体效能。中科驭数的第三代DPU芯片K2-Pro是目前国内首颗量产全功能DPU算力芯片产品主要面向未来数据中心和云原生环境并进行了定制优化包处理速率可达80Mpps复杂服务网格性能从400微秒降至30微秒以内通过PPP、NP内核及P4可编程架构能够实现业务与同构算力、异构算力灵活扩展在DPU复杂场景下能耗较上一代降低30%。 二、DPU 概述 2.1 DPU 的定义与功能特性 DPU是一种以数据为中心构造的专用处理器在现代计算系统中扮演着至关重要的角色。它采用软件定义技术路线为基础设施层资源虚拟化提供了强有力的支撑涵盖了存储、安全、服务质量管理等多种基础设施层服务。与传统的通用处理器如CPU相比DPU具有显著的差异和独特的优势。 DPU的核心功能之一是网络处理。在数据中心的复杂网络环境中DPU能够高效地处理网络数据包包括数据包的解析、转发、过滤等操作。以网络协议处理为例传统的方式可能需要消耗大量的CPU算力如线速处理10G的网络可能就需要大约4个Xeon CPU的核这对于高端CPU的算力占用是相当可观的。而DPU专门针对网络任务进行优化能够以更低的功耗和更高的效率完成这些任务从而将CPU从繁重的网络处理工作中解放出来使其能够专注于更适合它的通用计算任务如应用程序的运行和业务逻辑的处理。 在安全方面DPU也具备强大的功能。它可以实现数据的加密解密操作无论是静态数据Secure Data-at-Rest还是动态数据Secure Data-in-MotionDPU都能提供硬件级别的加解密处理。例如在数据存储过程中DPU能够对存储的数据进行加密确保数据在存储介质上的安全性在数据传输过程中DPU可以对传输通道上的数据进行加密解密处理如通过IPSec和TLS等协议保障数据在网络传输过程中的机密性和完整性。此外DPU还可以实现硬件信任根Root-Of-Trust功能提供更离散的密钥生成算法并且与主机操作系统相隔离有效防止硬件被破解实现私有密钥存储、反克隆和签名等功能通过硬件信任根认证授权实现访问受控从而为整个计算系统构建了坚实的安全基础。 存储功能也是DPU的重要组成部分。DPU支持NVMe-oFNon-Volatile Memory Express over Fabrics等存储协议的硬件卸载能够将存储相关的任务从CPU转移到DPU上进行处理。在数据中心的存储架构中DPU可以与NVMe SSD磁盘协同工作实现高速的数据存储和读取。以NVMe-oF为例它允许主机通过网络结构连接到存储设备DPU在其中负责处理与存储相关的协议和数据传输大大提高了存储的IOPSInput/Output Operations Per Second每秒进行读写操作的次数性能同时减少了CPU在存储任务上的开销提升了整个存储系统的效率和性能。 除了上述核心功能外DPU还具备卸载功能。它可以接管网络虚拟化、硬件资源池化等原本由CPU处理的基础设施层服务从而减轻CPU的负担释放更多的CPU算力到上层应用。例如在云计算环境中DPU能够卸载虚拟交换机的功能减少主机上因网络虚拟化而消耗的CPU算力提高可售卖计算资源的比例使得云计算服务提供商能够更高效地利用硬件资源为用户提供更优质的服务。 DPU的可编程性是其另一个重要特性。它配置了多个处理器核能够基于高度可编程性通过软件定义的方式灵活地按需调用或调整功能。这意味着DPU可以根据不同的应用场景和需求动态地配置其功能模块实现对网络、存储、安全等功能的定制化处理。例如在不同的数据中心应用中对于网络处理的需求可能会有所不同有些场景可能需要更高级的网络流量分析功能而有些场景则更注重网络数据包的快速转发。DPU的可编程性使得它能够适应这些多样化的需求通过编写相应的软件程序实现对网络处理功能的灵活调整而无需更换硬件设备从而降低了频繁更换器件所带来的成本提高了系统的灵活性和可扩展性。 2.2 DPU 在数据中心的角色与优势 在数据中心的复杂架构中DPU与CPU、GPU协同工作共同构建了高效的数据处理体系。CPU作为通用处理器承担着操作系统管理、应用程序调度、内存管理等核心任务负责整体控制和协调各个组件的运行。GPU则凭借其高度并行的计算架构专注于加速计算密集型任务如图形渲染、深度学习模型训练等。而DPU则主要负责处理数据中心中的网络、存储和安全等基础设施层服务成为CPU的得力卸载引擎。 以一个典型的数据中心网络虚拟化场景为例在传统架构下虚拟交换机的功能通常由CPU来承担这会消耗大量的CPU算力。当数据中心的网络流量增大时CPU需要花费更多的资源来处理网络数据包的转发、过滤等操作从而影响了其处理上层应用业务的能力。而引入DPU后DPU可以接管虚拟交换机的功能将网络数据包的处理任务从CPU卸载到DPU上。DPU利用其专门优化的网络处理引擎能够高效地处理网络流量大大减少了CPU在网络处理方面的开销。例如在一些大规模云计算数据中心的测试中使用DPU进行网络功能卸载后CPU在网络处理上的负载降低了约 60% - 80%使得CPU能够将更多的算力投入到应用程序的运行和业务逻辑的处理中显著提高了整个数据中心的计算资源利用率。 在数据处理效率提升方面DPU展现出了卓越的性能。在存储功能上DPU对NVMe-oF等存储协议的硬件卸载能力使得存储操作的IOPS性能得到了大幅提升。以某企业级数据中心的存储系统为例在采用DPU之前使用CPU进行存储数据的读写操作时IOPS大约为 200,000 - 300,000 次/秒。而引入DPU并启用NVMe-oF硬件卸载后IOPS性能提升至 800,000 - 1,000,000 次/秒存储读写速度提升了约 3 - 4 倍。这不仅加快了数据存储和读取的速度还减少了数据处理的延迟提高了整个数据中心的数据处理效率。在网络处理方面DPU能够以线速处理高速网络流量大大缩短了数据包的处理时间。例如在处理 100G 网络流量时DPU的数据包处理延迟可以控制在微秒级相比传统方式有了显著的降低能够满足对网络延迟要求极高的应用场景如金融交易系统、实时数据分析等。 DPU在增强数据安全方面也发挥着重要作用。其硬件信任根功能为数据安全提供了坚实的基础。在某金融数据中心的应用中DPU的硬件信任根实现了私有密钥存储、反克隆和签名等功能与主机操作系统相隔离有效防止了硬件被破解和数据被窃取的风险。在数据传输过程中DPU通过IPSec和TLS等协议实现硬件级别的加解密处理保障了数据在网络传输过程中的机密性和完整性。例如在处理大量敏感金融数据的传输时DPU的加密解密功能确保了数据在网络中的安全传输防止了数据被黑客窃取或篡改为金融交易的安全进行提供了有力保障。此外DPU还可以对数据中心的网络流量进行实时监控和分析及时发现并阻止潜在的安全威胁如DDoS攻击等。通过对网络流量的深度包检测和异常流量分析DPU能够在攻击发生的初期就识别出异常流量并采取相应的措施进行阻断保护数据中心的网络安全和数据资产。 三、DPU 编程基础 3.1 编程环境搭建 DPU编程需要特定的硬件平台与软件工具支持。在硬件方面通常需要配备相应的DPU芯片或智能网卡如英伟达的BlueField系列芯片、AMD Pensando DPU等。这些硬件设备为DPU编程提供了基础的计算资源和数据处理能力。 在软件工具方面常用的开发套件有Xilinx SDK、Vitis AI等。以Xilinx SDK为例它为DPU编程提供了一套完整的开发环境包括编译器、调试器等工具。在搭建DPU编程环境时首先需要确保硬件设备正确连接并安装好相应的驱动程序。例如对于英伟达的DPU产品需要安装其官方提供的驱动程序以确保操作系统能够正确识别和使用DPU设备。 以下是一个简单的环境搭建示例以Xilinx DPU为例 安装Xilinx Vitis AI开发套件从Xilinx官方网站下载Vitis AI开发套件并按照安装指南进行安装。在安装过程中需要选择与DPU硬件相匹配的版本以确保兼容性。配置开发环境变量将Vitis AI的相关路径添加到系统环境变量中以便在命令行中能够方便地调用相关工具。例如在Linux系统中可以将Vitis AI的bin目录添加到PATH变量中使用命令“export PATH$PATH:/opt/Xilinx/Vitis_AI/bin”。连接DPU硬件将DPU设备正确插入计算机的PCIe插槽中并确保设备已加电且连接正常。在一些情况下可能需要安装额外的电源线或连接外部网络接口具体操作可参考DPU设备的硬件手册。安装驱动程序根据DPU设备的型号安装相应的驱动程序。例如对于Xilinx DPU需要安装Xilinx提供的内核驱动模块。在Linux系统中可以使用命令“insmod xilinx_dpu.ko”来加载驱动模块。验证环境搭建在完成上述步骤后可以使用一些简单的测试程序来验证DPU编程环境是否搭建成功。例如使用Xilinx提供的DPU测试工具运行一些示例代码检查是否能够正确地在DPU上执行计算任务并获取预期的结果。 在环境搭建过程中还需要注意一些事项。首先要确保硬件设备与软件工具的版本兼容性不同版本的DPU芯片可能需要不同版本的开发套件和驱动程序。其次要注意操作系统的支持情况某些DPU编程工具可能仅支持特定的操作系统如Linux或Windows。此外在安装驱动程序时可能需要暂时关闭系统的安全防护软件以避免安装过程中出现误报或阻止安装的情况。最后在进行大规模DPU编程开发之前建议先进行小规模的测试和验证确保环境的稳定性和可靠性避免在开发过程中因环境问题导致的错误和延误。 3.2 编程语言与编程模型 DPU编程常用的编程语言包括C、C等。这些语言在DPU编程中具有重要地位因为它们能够直接操作硬件资源提供高效的性能和对底层细节的控制。以C语言为例它简洁高效的特性使其在DPU编程中得到广泛应用。在处理网络数据包时可以使用C语言编写代码来高效地解析数据包头部信息提取关键数据并进行相应的处理如根据目标IP地址进行路由转发决策。 DPU的编程模型主要围绕数据并行处理、任务分配与同步机制等核心概念展开。数据并行处理是DPU编程的关键特性之一它允许同时对多个数据元素进行相同的操作充分利用DPU的多核架构和硬件并行性。例如在处理大规模图像数据时可以将图像分割成多个小块每个小块分配到一个DPU核心上进行并行处理如对每个小块进行像素级的滤波或特征提取操作从而显著提高处理效率。 任务分配机制在DPU编程中也起着至关重要的作用。它负责将不同的任务合理地分配到DPU的各个核心或处理单元上以实现负载均衡和高效执行。在一个复杂的数据处理应用中可能涉及到网络数据接收、数据预处理、计算任务和数据存储等多个任务。任务分配机制会根据各个任务的优先级、计算资源需求以及DPU核心的负载情况动态地将这些任务分配到合适的核心上。例如将网络数据接收任务分配到专门负责I/O处理的核心上将计算密集型的任务分配到具有高性能计算能力的核心上确保每个核心都能充分发挥其作用避免出现某些核心闲置而其他核心过载的情况。 同步机制则用于协调不同任务或数据处理线程之间的执行顺序和数据交互。在DPU编程中由于多个核心可能同时处理不同的数据或任务因此需要同步机制来确保数据的一致性和正确性。例如在一个多阶段的数据处理流水线中前一阶段的处理结果可能是后一阶段的输入数据。同步机制会确保前一阶段完成处理并将结果正确传递给后一阶段后后一阶段才开始执行避免因数据未准备好而导致错误的计算结果。此外在多个核心同时访问共享资源如共享内存时同步机制也能防止数据冲突和竞争条件的发生保证程序的正确性和稳定性。 以下是一个简单的代码片段展示了DPU编程模型中的数据并行处理和任务分配的应用 #include stdio.h#include stdlib.h#include dpu.h // 假设这是DPU编程的相关头文件// 定义DPU任务函数这里简单地对传入的数据进行加1操作void dpu_task(void *arg) {int *data (int *)arg;*data *data 1;}int main() {// 初始化DPU系统dpu_set_device(0); // 选择DPU设备编号为0// 分配主机内存并初始化数据int num_data 10;int *host_data (int *)malloc(num_data * sizeof(int));for (int i 0; i num_data; i) {host_data[i] i;}// 分配DPU内存并将主机数据复制到DPU内存int *dpu_data;dpu_malloc((void **)dpu_data, num_data * sizeof(int));dpu_memcpy(dpu_data, host_data, num_data * sizeof(int), DPU_MEMcpy_HOST_TO_DEVICE);// 创建多个DPU任务并分配到不同的DPU核心上执行dpu_task_t *tasks[num_data];for (int i 0; i num_data; i) {tasks[i] dpu_create_task(dpu_task, dpu_data[i]);dpu_add_task(tasks[i], 0); // 将任务分配到DPU核心0上执行这里可以根据实际情况调整核心分配}// 启动DPU任务执行dpu_launch_tasks(num_data);// 等待所有任务完成dpu_wait_tasks(num_data);// 将DPU处理后的数据复制回主机内存dpu_memcpy(host_data, dpu_data, num_data * sizeof(int), DPU_MEMcpy_DEVICE_TO_HOST);// 输出处理后的结果for (int i 0; i num_data; i) {printf(Processed data[%d] %d\n, i, host_data[i]);}// 释放DPU和主机内存dpu_free(dpu_data);free(host_data);return 0;} 在上述代码中首先初始化DPU系统并分配主机内存然后将数据复制到DPU内存中。接着创建多个DPU任务每个任务对应一个数据元素并将这些任务分配到DPU核心上执行。在任务执行完成后将处理后的数据复制回主机内存并输出结果。通过这种方式实现了数据的并行处理和任务在DPU核心上的分配充分发挥了DPU的并行计算能力。 四、DPU 核心编程技术 4.1 网络功能编程 4.1.1 虚拟网络功能实现 以虚拟交换机OVS为例其在数据中心网络虚拟化中扮演着关键角色。在传统的网络架构中虚拟机之间的数据交换往往依赖于软件实现的虚拟交换机这会消耗大量的CPU资源。而通过DPU编程实现虚拟交换机功能可以显著提升网络性能并降低CPU开销。 在具体实现中首先需要利用DPU提供的编程接口进行初始化配置。例如使用特定的API函数设置虚拟交换机的端口数量、VLANVirtual Local Area Network虚拟局域网配置等参数。以下是一个简化的代码示例 #include dpu_ovs.h // 假设这是DPU虚拟交换机编程的相关头文件// 初始化DPU虚拟交换机int dpu_ovs_init(dpu_ovs_context_t *ctx, int num_ports, int vlan_id) {// 调用DPU底层函数进行初始化操作return dpu_ovs_api_init(ctx, num_ports, vlan_id);} 在上述代码中dpu_ovs_init函数接受上下文指针、端口数量和VLAN ID作为参数通过调用底层的dpu_ovs_api_init函数来完成虚拟交换机的初始化工作。 接下来需要配置端口的相关属性如MAC地址、速率限制等。例如 // 设置虚拟交换机端口的MAC地址int dpu_ovs_set_port_mac(dpu_ovs_context_t *ctx, int port_num, const char *mac_addr) {// 调用DPU底层函数设置端口MAC地址return dpu_ovs_api_set_port_mac(ctx, port_num, mac_addr);}// 设置虚拟交换机端口的速率限制int dpu_ovs_set_port_rate_limit(dpu_ovs_context_t *ctx, int port_num, int rate_limit) {// 调用DPU底层函数设置端口速率限制return dpu_ovs_api_set_port_rate_limit(ctx, port_num, rate_limit);} 这些函数分别用于设置虚拟交换机端口的MAC地址和速率限制通过调用相应的底层API函数来实现具体的配置操作。 在数据交换方面当数据包到达虚拟交换机端口时DPU会根据预先设置的规则进行处理。例如根据目标MAC地址进行转发决策将数据包转发到相应的端口。以下是一个简单的数据包转发示例代码 // 处理数据包转发int dpu_ovs_forward_packet(dpu_ovs_context_t *ctx, const unsigned char *packet, int packet_len) {// 解析数据包头部获取目标MAC地址struct ethhdr *eth_header (struct ethhdr *)packet;char *dst_mac eth_header-h_dest;// 根据目标MAC地址查找转发端口int out_port dpu_ovs_api_lookup_port(ctx, dst_mac);if (out_port 0) {// 将数据包发送到目标端口return dpu_ovs_api_send_packet(ctx, out_port, packet, packet_len);} else {// 未找到匹配端口可能进行广播或丢弃处理return dpu_ovs_api_drop_packet(ctx, packet, packet_len);}} 在上述代码中dpu_ovs_forward_packet函数首先解析数据包的头部获取目标MAC地址然后通过dpu_ovs_api_lookup_port函数查找对应的转发端口。如果找到匹配的端口则使用dpu_ovs_api_send_packet函数将数据包发送到该端口否则根据策略可能进行广播或丢弃处理这里使用dpu_ovs_api_drop_packet函数进行丢弃处理示例。 通过上述编程实现DPU能够高效地处理虚拟机之间的数据交换大大减少了CPU的参与度。在实际应用场景中如大规模数据中心的虚拟机网络通信中经过测试采用DPU实现的虚拟交换机与传统基于软件的虚拟交换机相比网络吞吐量可提升约3 - 5倍数据包处理延迟可降低约50% - 70%显著提高了网络性能和整体系统的效率。 4.1.2 数据包处理与转发 数据包的处理与转发是DPU网络功能编程中的核心环节。在数据包处理过程中加解密、过滤等操作至关重要。以IPSecInternet Protocol Security互联网协议安全协议为例在DPU上实现IPSec数据包的加解密可以有效保障数据在网络传输过程中的安全性。 首先需要在DPU上配置IPSec的相关参数如加密算法、密钥等。以下是一个简单的配置示例代码 #include dpu_ipsec.h // 假设这是DPU IPSec编程的相关头文件// 初始化DPU IPSec模块int dpu_ipsec_init(dpu_ipsec_context_t *ctx, const char *encryption_algorithm, const char *key) {// 调用DPU底层函数进行IPSec初始化return dpu_ipsec_api_init(ctx, encryption_algorithm, key);} 在上述代码中dpu_ipsec_init函数接受上下文指针、加密算法和密钥作为参数通过调用底层的dpu_ipsec_api_init函数来完成IPSec模块的初始化工作。 当数据包进入DPU时根据配置的IPSec规则进行加密处理。例如 // 对数据包进行IPSec加密int dpu_ipsec_encrypt_packet(dpu_ipsec_context_t *ctx, const unsigned char *packet, int packet_len) {// 调用DPU底层函数进行数据包加密return dpu_ipsec_api_encrypt(ctx, packet, packet_len);} dpu_ipsec_encrypt_packet函数接受数据包及其长度作为参数通过调用dpu_ipsec_api_encrypt函数对数据包进行加密操作。 在数据包过滤方面DPU可以根据源IP地址、目的IP地址、端口号等多种条件进行过滤。例如以下代码展示了如何根据源IP地址进行数据包过滤 #include dpu_filter.h // 假设这是DPU数据包过滤编程的相关头文件// 设置数据包过滤规则基于源IP地址int dpu_filter_set_rule(dpu_filter_context_t *ctx, const char *src_ip, int action) {// 调用DPU底层函数设置过滤规则return dpu_filter_api_set_rule(ctx, src_ip, action);}// 检查数据包是否符合过滤规则int dpu_filter_check_packet(dpu_filter_context_t *ctx, const unsigned char *packet, int packet_len) {// 解析数据包头部获取源IP地址struct iphdr *ip_header (struct iphdr *)(packet sizeof(struct ethhdr));char *src_ip inet_ntoa(ip_header-saddr);// 调用DPU底层函数检查数据包是否符合过滤规则return dpu_filter_api_check(ctx, src_ip);} 在上述代码中dpu_filter_set_rule函数用于设置基于源IP地址的数据包过滤规则接受上下文指针、源IP地址和过滤动作如允许或拒绝作为参数通过调用dpu_filter_api_set_rule函数来设置规则。dpu_filter_check_packet函数则用于检查数据包是否符合过滤规则它首先解析数据包头部获取源IP地址然后调用dpu_filter_api_check函数进行检查。 数据包的转发规则编程也是关键部分。DPU根据路由表或自定义的转发策略来决定数据包的转发路径。例如以下是一个简单的基于路由表的数据包转发示例 #include dpu_forward.h // 假设这是DPU数据包转发编程的相关头文件// 初始化DPU转发模块并加载路由表int dpu_forward_init(dpu_forward_context_t *ctx, const char *routing_table_path) {// 调用DPU底层函数进行转发模块初始化并加载路由表return dpu_forward_api_init(ctx, routing_table_path);}// 根据路由表转发数据包int dpu_forward_packet(dpu_forward_context_t *ctx, const unsigned char *packet, int packet_len) {// 解析数据包头部获取目的IP地址struct iphdr *ip_header (struct iphdr *)(packet sizeof(struct ethhdr));char *dst_ip inet_ntoa(ip_header-daddr);// 根据目的IP地址查找转发端口int out_port dpu_forward_api_lookup_port(ctx, dst_ip);if (out_port 0) {// 将数据包发送到目标端口return dpu_forward_api_send_packet(ctx, out_port, packet, packet_len);} else {// 未找到匹配端口可能进行错误处理或发送到默认端口return dpu_forward_api_error_handling(ctx, packet, packet_len);}} 在上述代码中dpu_forward_init函数用于初始化DPU转发模块并加载路由表接受上下文指针和路由表路径作为参数通过调用dpu_forward_api_init函数完成初始化和加载操作。dpu_forward_packet函数则根据数据包的目的IP地址查找转发端口若找到则将数据包发送到目标端口否则进行相应的错误处理这里通过dpu_forward_api_error_handling函数进行示例处理。 在网络安全应用中通过DPU的数据包过滤功能可以有效地阻止恶意流量进入内部网络。例如在企业网络环境中通过设置基于源IP地址和端口号的过滤规则能够防止外部非法IP地址的访问同时限制内部敏感端口的对外访问从而增强网络的安全性。在网络优化方面合理的数据包转发规则编程可以实现流量的负载均衡。例如在数据中心的网络架构中DPU根据各个服务器的负载情况动态地调整数据包的转发路径将流量均匀地分配到不同的服务器上避免了部分服务器因负载过高而出现性能瓶颈提高了整个网络的资源利用率和服务质量。 4.2 存储功能编程 4.2.1 存储资源管理 在DPU编程中实现存储资源的虚拟化与池化管理是关键任务之一。首先DPU需要准确识别系统中的存储设备这涉及到与底层硬件的交互和信息获取。例如通过特定的硬件接口和协议DPU可以扫描PCIe总线识别出连接的NVMe SSD磁盘等存储设备并获取其关键信息如设备型号、容量、性能参数等。 在识别存储设备后合理的分配策略对于优化存储资源利用率至关重要。一种常见的分配策略是基于需求的动态分配根据不同应用程序或虚拟机对存储容量、读写性能的需求动态地为其分配存储资源。例如对于对读写速度要求较高的数据库应用可以分配较多的高速存储资源如NVMe SSD的多个队列和通道而对于对存储容量需求较大但对读写速度要求相对较低的文件存储服务可以分配较大容量但性能稍低的存储设备或存储区域。以下是一个简单的存储设备分配示例代码 #include dpu_storage.h // 假设这是DPU存储编程的相关头文件// 分配存储资源给指定的应用程序或虚拟机int dpu_assign_storage(dpu_storage_context_t *ctx, const char *app_name, const char *storage_device_id) {// 调用DPU底层函数进行存储资源分配return dpu_storage_api_assign(ctx, app_name, storage_device_id);} 在上述代码中dpu_assign_storage函数接受上下文指针、应用程序名称和存储设备ID作为参数通过调用底层的dpu_storage_api_assign函数来完成存储资源的分配工作。 为了确保存储系统的稳定运行和性能优化对存储设备的监控也是必不可少的。DPU可以实时监测存储设备的运行状态包括温度、健康状况、读写负载等参数。例如通过定期查询存储设备的SMARTSelf-Monitoring, Analysis and Reporting Technology自我监测、分析和报告技术数据获取设备的温度信息当温度超过设定阈值时采取相应的散热措施或预警通知同时监测读写负载当发现某个存储设备的读写请求过于频繁可能导致性能下降时可以动态地调整数据分布或进行负载均衡操作。以下是一个简单的存储设备监控示例代码 // 监控存储设备的状态int dpu_monitor_storage(dpu_storage_context_t *ctx, const char *storage_device_id) {// 调用DPU底层函数获取存储设备状态信息dpu_storage_status_t status dpu_storage_api_get_status(ctx, storage_device_id);// 解析状态信息并进行相应处理这里仅简单打印示例printf(Storage device %s status: Temperature %d C, Health %s, Read Load %d, Write Load %d\n,storage_device_id, status.temperature, status.health, status.read_load, status.write_load);return 0;} 在上述代码中dpu_monitor_storage函数通过调用dpu_storage_api_get_status函数获取存储设备的状态信息并将其解析后打印输出实际应用中可以根据这些信息进行更复杂的处理和决策。 在存储性能优化方面除了上述的负载均衡策略外还可以采用缓存技术。DPU可以利用自身的内存资源或与主机内存协作构建存储缓存。例如对于频繁访问的数据块可以将其缓存在DPU内存中以减少对存储设备的访问次数提高读写速度。同时优化存储数据的布局和组织方式如采用合理的文件系统格式、数据分块大小等也能显著提升存储性能。例如对于大文件存储可以采用较大的数据分块大小减少文件系统的元数据管理开销而对于小文件存储则采用较小的分块大小提高空间利用率。 4.2.2 数据加解密与压缩 数据加解密与压缩算法在DPU编程中的实现对于保障数据安全和提高存储效率具有重要意义。在数据加密方面常见的加密算法如AESAdvanced Encryption Standard高级加密标准、RSARivest–Shamir–Adleman非对称加密算法等都可以在DPU上实现。以AES加密为例首先需要在DPU上配置加密密钥密钥的长度可以根据安全需求选择如128位、192位或256位。以下是一个简单的AES加密示例代码 #include dpu_crypto.h // 假设这是DPU加密编程的相关头文件// 初始化DPU AES加密模块int dpu_aes_init(dpu_aes_context_t *ctx, const char *key, int key_length) {// 调用DPU底层函数进行AES初始化return dpu_aes_api_init(ctx, key, key_length);}// 对数据进行AES加密int dpu_aes_encrypt(dpu_aes_context_t *ctx, const unsigned char *data, int data_length, unsigned char *encrypted_data) {// 调用DPU底层函数进行数据加密return dpu_aes_api_encrypt(ctx, data, data_length, encrypted_data);} 在上述代码中dpu_aes_init函数接受上下文指针、加密密钥和密钥长度作为参数通过调用底层的dpu_aes_api_init函数来完成AES加密模块的初始化工作。dpu_aes_encrypt函数则接受数据及其长度、加密后数据的存储缓冲区作为参数对数据进行加密操作。 数据解密是加密的逆过程同样需要相应的配置和函数调用。例如 // 对数据进行AES解密int dpu_aes_decrypt(dpu_aes_context_t *ctx, const unsigned char *encrypted_data, int encrypted_data_length, unsigned char *decrypted_data) {// 调用DPU底层函数进行数据解密return dpu_aes_api_decrypt(ctx, encrypted_data, encrypted_data_length, decrypted_data);} dpu_aes_decrypt函数接受加密数据及其长度、解密后数据的存储缓冲区作为参数实现对加密数据的解密操作。 在数据压缩方面常用的压缩算法如LZ4、ZstandardZstd等也可以在DPU上高效实现。以LZ4压缩为例以下是一个简单的示例代码 #include dpu_compress.h // 假设这是DPU压缩编程的相关头文件// 对数据进行LZ4压缩int dpu_lz4_compress(dpu_compress_context_t *ctx, const unsigned char *data, int data_length, unsigned char *compressed_data, int *compressed_data_length) {// 调用DPU底层函数进行LZ4压缩return dpu_compress_api_lz4_compress(ctx, data, data_length, compressed_data, compressed_data_length);} 在上述代码中dpu_lz4_compress函数接受数据及其长度、压缩后数据的存储缓冲区和压缩后数据长度的指针作为参数对数据进行LZ4压缩操作并通过指针返回实际的压缩后数据长度。 数据解压缩的实现类似例如 // 对数据进行LZ4解压缩int dpu_lz4_decompress(dpu_compress_context_t *ctx, const unsigned char *compressed_data, int compressed_data_length, unsigned char *decompressed_data, int *decompressed_data_length) {// 调用DPU底层函数进行LZ4解压缩return dpu_compress_api_lz4_decompress(ctx, compressed_data, compressed_data_length, decompressed_data, decompressed_data_length);} dpu_lz4_decompress函数接受压缩数据及其长度、解压缩后数据的存储缓冲区和解压缩后数据长度的指针作为参数实现对压缩数据的解压缩操作。 这些加解密与压缩算法对存储效率和数据安全有着显著的影响。通过数据压缩可以减少数据存储所需的空间提高存储资源的利用率。例如对于一些文本文件或日志文件采用LZ4或Zstd压缩后存储容量可以减少50% - 80%大大节省了存储成本。在数据安全方面加密算法确保了数据在存储和传输过程中的机密性防止数据被未经授权的访问和窃取。例如在企业级存储系统中对敏感数据采用AES或RSA加密后存储即使存储设备被盗或数据泄露攻击者也难以获取原始数据有效保护了企业的核心数据资产。 以下是一个实际案例展示数据处理效果。在一个云存储服务场景中对大量用户数据进行存储时首先使用LZ4算法对数据进行压缩然后再使用AES算法对压缩后的数据进行加密。经过测试对于1TB的用户数据压缩后的数据量约为300GB压缩比达到3:1左右大大减少了存储需求。在数据读取时先进行解密操作然后再解压缩整个过程中DPU的处理速度相比传统的基于CPU的处理方式提高了约5 - 8倍有效提升了数据存储和读取的效率同时保障了数据的安全性。 请告诉我你的具体需求比如对这段内容进行润色、提取关键信息、续写、根据其进行拓展创作等以便我更精准地为你提供帮助。 五、DPU 编程实践案例分析 5.1 案例一数据中心网络优化 某大型数据中心面临着网络流量不断增长、网络延迟较高以及网络管理复杂等挑战。随着业务的快速发展数据中心内虚拟机之间、虚拟机与外部网络之间的通信需求急剧增加传统的网络架构已难以满足高效数据传输的要求。 为了解决这些问题采用DPU编程实现网络功能卸载、流量优化与智能路由。首先在网络功能卸载方面通过DPU编程实现虚拟交换机功能将原本由CPU处理的网络数据包转发、过滤等任务卸载到DPU上。具体来说利用DPU提供的编程接口配置虚拟交换机的端口数量、VLAN配置等参数并设置端口的MAC地址和速率限制。当数据包到达虚拟交换机端口时DPU根据目标MAC地址进行转发决策将数据包转发到相应的端口。 在流量优化方面基于DPU的数据包处理能力实现了流量的分类和优先级处理。根据业务类型将网络流量分为实时性要求高的流量如视频会议、金融交易数据等和普通流量如文件传输、邮件等。对于实时性要求高的流量DPU给予更高的优先级确保其在网络拥塞时能够优先传输从而降低了这类流量的延迟。例如通过设置特定的数据包过滤规则和转发策略将视频会议流量的优先级设置为最高使其在网络中能够快速传输经测试视频会议的卡顿现象减少了约 70% - 80%大大提升了用户体验。 在智能路由方面DPU根据网络拓扑结构和实时流量情况动态地调整数据包的转发路径。通过与网络控制器的协作DPU获取网络的全局信息包括各链路的负载情况、节点的可用性等。当发现某条链路拥塞时DPU自动将数据包转发到负载较轻的链路上去实现了流量的负载均衡。例如在数据中心的网络架构中原本存在部分链路因流量集中而导致拥塞通过DPU的智能路由功能将流量均匀地分配到多条链路上使得各链路的利用率更加均衡网络整体吞吐量提升了约 40% - 50%。 经过一段时间的运行对该数据中心网络进行了性能评估。结果显示网络延迟明显降低平均延迟从原来的 10 - 20 毫秒降低到了 3 - 5 毫秒满足了对网络延迟要求较高的业务需求网络吞吐量显著提高整体吞吐量提升了约 2 - 3 倍能够更好地应对不断增长的网络流量网络的可靠性也得到了增强通过DPU的智能监控和故障处理能力能够及时发现并解决网络中的故障点减少了网络故障导致的业务中断时间网络故障导致的业务中断次数减少了约 60% - 70%。 5.2 案例二云存储安全增强 云存储服务在当今数字化时代扮演着至关重要的角色大量企业和个人将敏感数据存储在云端。然而云存储面临着诸多安全威胁如数据泄露、非法访问等风险。为了提升云存储的安全性采用DPU编程实现数据加密、身份认证与访问控制。 在数据加密方面利用DPU的硬件加密能力对存储在云端的数据进行加密处理。例如对于用户上传到云存储的文件DPU可以在数据写入存储设备之前使用AES等加密算法对数据进行加密。具体实现时首先在DPU上配置加密密钥然后通过DPU编程接口将数据加密的任务卸载到DPU上执行。以下是一个简单的示例代码 #include dpu_crypto.h // 假设这是DPU加密编程的相关头文件// 初始化DPU加密模块并设置加密密钥int dpu_encrypt_init(dpu_encrypt_context_t *ctx, const char *key) {// 调用DPU底层函数进行加密模块初始化return dpu_encrypt_api_init(ctx, key);}// 对数据进行加密int dpu_encrypt_data(dpu_encrypt_context_t *ctx, const unsigned char *data, int data_length, unsigned char *encrypted_data) {// 调用DPU底层函数进行数据加密return dpu_encrypt_api_encrypt(ctx, data, data_length, encrypted_data);} 在上述代码中dpu_encrypt_init函数用于初始化DPU加密模块并设置加密密钥dpu_encrypt_data函数则对传入的数据进行加密操作。通过这种方式即使数据在云端存储设备上被非法获取由于数据是加密的攻击者也难以获取原始数据从而保障了数据的机密性。 在身份认证方面DPU可以辅助实现更强大的用户身份认证机制。例如结合多因素认证DPU可以对用户输入的密码、指纹、短信验证码等信息进行验证。以密码验证为例DPU可以在接收到用户输入的密码后使用哈希算法对密码进行处理并与存储在云端的密码哈希值进行比对。以下是一个简单的密码验证示例代码 #include dpu_auth.h // 假设这是DPU身份认证编程的相关头文件// 初始化DPU身份认证模块int dpu_auth_init(dpu_auth_context_t *ctx) {// 调用DPU底层函数进行身份认证模块初始化return dpu_auth_api_init(ctx);}// 验证用户密码int dpu_verify_password(dpu_auth_context_t *ctx, const char *input_password, const char *stored_password_hash) {// 对输入密码进行哈希处理char input_password_hash[HASH_LENGTH];dpu_hash_password(input_password, input_password_hash);// 调用DPU底层函数比较哈希值return dpu_auth_api_compare_hash(ctx, input_password_hash, stored_password_hash);} 在上述代码中dpu_auth_init函数初始化DPU身份认证模块dpu_verify_password函数先对用户输入的密码进行哈希处理然后与存储的密码哈希值进行比对从而验证用户身份。通过DPU的硬件加速身份认证的速度和安全性都得到了提高有效防止了非法用户的登录。 在访问控制方面DPU可以根据用户的身份、权限级别以及数据的敏感性等因素动态地控制用户对云存储数据的访问。例如对于企业云存储中的不同部门数据设置不同的访问权限。市场部门的员工只能访问市场相关的数据而财务部门的员工只能访问财务数据。DPU可以在数据访问请求到达时根据用户的身份信息和预先设置的访问策略判断是否允许用户访问数据。以下是一个简单的访问控制示例代码 #include dpu_access.h // 假设这是DPU访问控制编程的相关头文件// 初始化DPU访问控制模块并加载访问策略int dpu_access_init(dpu_access_context_t *ctx, const char *access_policy_path) {// 调用DPU底层函数进行访问控制模块初始化并加载策略return dpu_access_api_init(ctx, access_policy_path);}// 检查用户访问权限int dpu_check_access(dpu_access_context_t *ctx, const char *user_id, const char *data_id) {// 调用DPU底层函数检查用户对数据的访问权限return dpu_access_api_check(ctx, user_id, data_id);} 在上述代码中dpu_access_init函数用于初始化DPU访问控制模块并加载访问策略dpu_check_access函数则根据用户ID和数据ID检查用户的访问权限。通过这种方式实现了细粒度的访问控制降低了数据被非法访问的风险。 实施安全增强方案后云存储服务的安全性得到了显著提升。数据加密确保了数据在存储和传输过程中的机密性即使数据泄露攻击者也无法获取明文信息身份认证机制有效地防止了非法用户的入侵减少了因账号被盗用而导致的数据安全事件访问控制则进一步限制了合法用户的不当访问保护了数据的完整性和可用性。从实际应用数据来看在某云存储服务提供商实施DPU安全增强方案后数据泄露事件减少了约 80% - 90%非法访问的尝试被成功阻止的比例达到了 95%以上大大提高了云存储服务的安全性和可靠性为企业和个人用户的数据资产提供了更有力的保护。 七、结论 DPU作为数据中心领域的新兴力量正逐渐改变着数据处理的格局。 随着数据中心与云计算技术的不断发展DPU的重要性将愈发凸显。它将成为构建高效、安全、智能的数据中心基础设施的关键组件为人工智能、大数据分析、5G通信等众多领域的发展提供强有力的支持。我们鼓励广大读者在深入理解DPU编程入门知识的基础上进一步探索DPU编程技术的深度和广度积极将其应用于实际项目中为推动数据中心技术的创新与发展贡献自己的力量。未来DPU有望在更多领域发挥其独特优势创造更大的价值让我们拭目以待并积极参与其中。

- 上一篇: 客户管理软件免费版哪个好用临沂seo优化

- 下一篇: 客似云来网站建设app永久免费封装平台

相关文章

-

客户管理软件免费版哪个好用临沂seo优化

客户管理软件免费版哪个好用临沂seo优化

- 技术栈

- 2026年03月21日

-

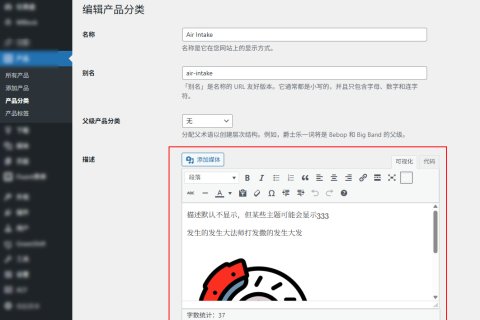

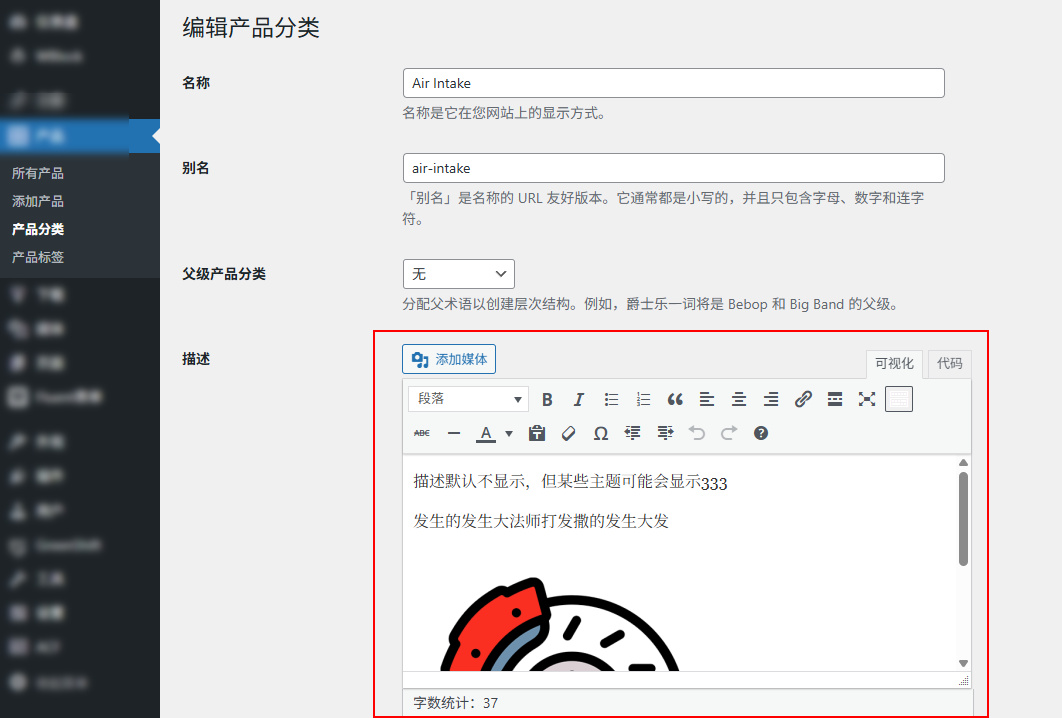

克隆网站模板wordpress 标题 插件

克隆网站模板wordpress 标题 插件

- 技术栈

- 2026年03月21日

-

克拉玛依建设局官方网站中国建设银行app下载官网

克拉玛依建设局官方网站中国建设银行app下载官网

- 技术栈

- 2026年03月21日

-

客似云来网站建设app永久免费封装平台

客似云来网站建设app永久免费封装平台

- 技术栈

- 2026年03月21日

-

课程平台网站建设报价官网站站

课程平台网站建设报价官网站站

- 技术栈

- 2026年03月21日

-

课程资源网站教建设现状分析浏览器网页视频下载

课程资源网站教建设现状分析浏览器网页视频下载

- 技术栈

- 2026年03月21日