【爬虫】python requests模拟登录知乎

- 作者: 五速梦信息网

- 时间: 2026年05月04日 13:56

需求:模拟登录知乎,因为知乎首页需要登录才可以查看,所以想爬知乎上的内容首先需要登录,那么问题来了,怎么用python进行模拟登录以及会遇到哪些问题?

前期准备:

环境:ubuntu,python2.7

需要的包:requests包、正则表达式包

安装requests:pip install requests,关于requests的介绍可以看官方介绍:http://cn.python-requests.org/zh_CN/latest/user/quickstart.html , 以及 http://cuiqingcai.com/2556.html 讲的也很好,简单明了

requests包其实是代替了urllib2,并且提供了大量简洁好用的方法调用。

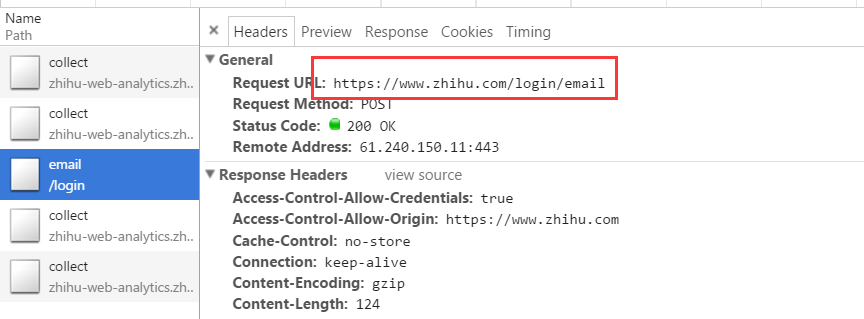

注意:通过Chrome Devtool可以看到知乎登录的URL是:https//www.zhihu.com/login/email,使用邮箱进行登录。

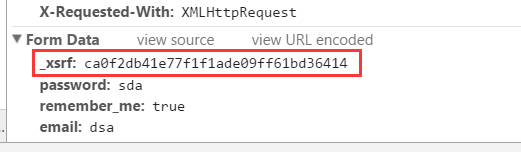

登录的方式为POST,需要的参数有四个分别是:_xsrf、password、remember_me和email,除了第一个都很好理解,那么第一个参数是什么?

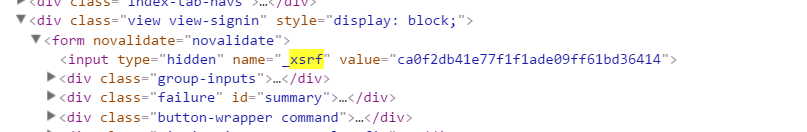

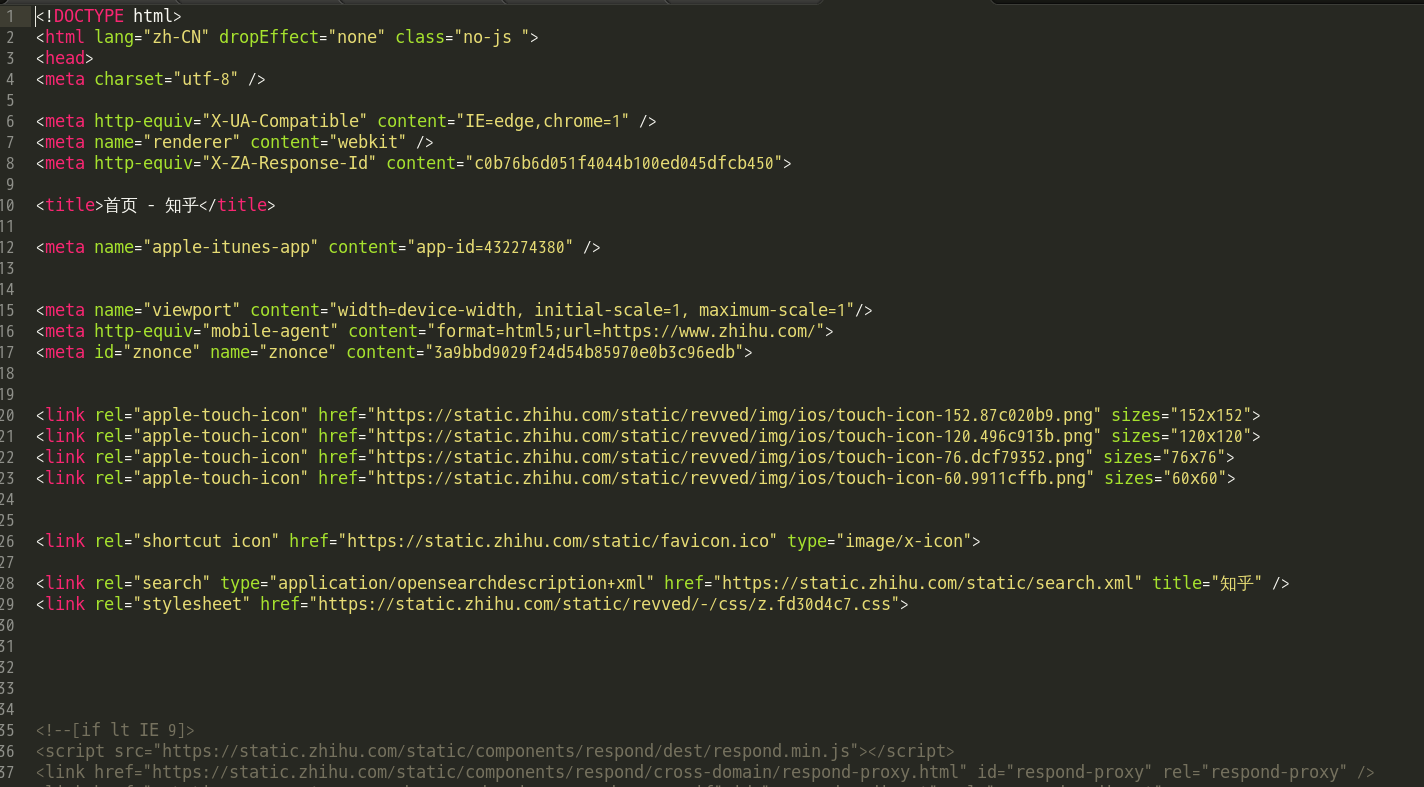

XSRF为跨站请求伪造(Cross-site request forgery),通过搜集资料,在大神的博客里找到有相应资料,http://cuiqingcai.com/2076.html ,说的也很清楚,有兴趣可以查看。这个参数目的就是为了防范XSRF攻击而设置的一个hash值,每次访问主页都会生成这样一个唯一的字符串。那么怎么获取这个参数的值,经过对知乎首页(https://www.zhihu.com)的代码查看可以看到有一个隐藏的标签:

那么就好解决了,直接在爬下来的网页内容中用正则表达式去匹配就OK了。

代码:

最后,就成功把知乎首页的内容抓取下来了!下一步可以进行分析和筛选了。

- 上一篇: 【驱动】SPI驱动分析(七)

- 下一篇: 【面试题精讲】什么是websocket?如何与前端通信?

相关文章

-

【驱动】SPI驱动分析(七)

【驱动】SPI驱动分析(七)

- 互联网

- 2026年05月04日

-

【驱动】SPI驱动分析(五)

【驱动】SPI驱动分析(五)

- 互联网

- 2026年05月04日

-

【趣事】用 JavaScript 对抗 DDOS 攻击 (下)

【趣事】用 JavaScript 对抗 DDOS 攻击 (下)

- 互联网

- 2026年05月04日

-

【面试题精讲】什么是websocket?如何与前端通信?

【面试题精讲】什么是websocket?如何与前端通信?

- 互联网

- 2026年05月04日

-

【面试题精讲】Redis如何实现分布式锁

【面试题精讲】Redis如何实现分布式锁

- 互联网

- 2026年05月04日

-

【面试普通人VS高手系列】innoDB如何解决幻读

【面试普通人VS高手系列】innoDB如何解决幻读

- 互联网

- 2026年05月04日