pycharm使用pyspark

- 作者: 五速梦信息网

- 时间: 2026年06月03日 13:35

pycharm使用pyspark

- 2024-09-02

1 下载官网spark-2.1.1-bin-hadoop2.7.tgz(版本自己选择),解压将文件放在了指定路径下,这个文件夹里面有python文件,python文件下还有两个压缩包py4j-some-version.zip和pyspark.zip,之后会用到) 2 pycharm使用pyspark时from pyspark import SparkContext,代码依然划红线,运行依然显示没有该模块. 3 随便打开一个project,pycharm右上角“run”三角形的左边有一个run c

前提: 1.已经安装好spark.我的是spark2.2.0. 2.已经有python环境,我这边使用的是python3.6. 一.安装py4j 使用pip,运行如下命令: pip install py4j 使用conda,运行如下命令: conda install py4j 二.使用pycharm创建一个project. 创建过程中选择python的环境.进入之后点击Run-->Edit Configurations-->Environment variables. 添加PYTHONPATH

在安装Spark之前,我们需要在自己的系统当中先安装上jdk和scala 可以去相应的官网上下载: JDK:http://www.oracle.com/technetwork/java/javase/downloads/jdk8-downloads-2133151.html scala:http://www.scala-lang.org/download/ 下载完成后可以得到这样两个压缩包 安装JDK 首先我们先来安装jdk, sudo mkdir /usr/lib/jdk 1 用这条语句来创

PySpark in PyCharm on a remote server 1.确保remote端Python.spark安装正确 2.remote端安装.设置 vi /etc/profile添加一行:PYTHONPATH=$SPARK_HOME/python/:$SPARK_HOME/python/lib/py4j-0.8.2.1-src.zipsource /etc/profile # 安装pip 和 py4j 下载pip-7.1.2.tartar -xvf pip-7.1.2.tarcd

AS WE ALL KNOW,学机器学习的一般都是从python+sklearn开始学,适用于数据量不大的场景(这里就别计较“不大”具体指标是啥了,哈哈) 数据量大了,就需要用到其他技术了,如:spark, tensorflow,当然也有其他技术,此处略过一坨字... 先来看看如何让这3个集成起来吧(WINDOWS环境):pycharm(python开发环境), pyspark.cmd(REPL命令行接口), spark(spark驱动.MASTER等) download Anaconda, l

实习后面需要用到spark,虽然之前跟了edX的spark的课程以及用spark进行machine learning,但那个环境是官方已经搭建好的,但要在自己的系统里将PySpark导入shell(或在Python里可以import pyspark)还是需要做一些操作的.(下图,忘了先define一个sc,+.+|||)自己built的和官方pre-built的版本都可以使用 这个方法. 我们的目标是 任意目录下在shell里启动pyspark 在Python里import pyspark(包括

AS WE ALL KNOW,学机器学习的一般都是从python+sklearn开始学,适用于数据量不大的场景(这里就别计较“不大”具体指标是啥了,哈哈) 数据量大了,就需要用到其他技术了,如:spark, tensorflow,当然也有其他技术,此处略过一坨字... 先来看看如何让这3个集成起来吧(WINDOWS环境):pycharm(python开发环境), pyspark.cmd(REPL命令行接口), spark(spark驱动.MASTER等) download Anaconda, l

一种方法: File --> Default Setting --> 选中Project Interpreter中的一个python版本-->点击右边锯齿形图标(设置)-->选择more-->选择刚才选中的那个python版本-->点击最下方编辑(也就是增加到这个python版本下)-->点击➕-->选中spark安装目录下的python目录-->一路OK. 再次在python文件中写入如下 from pyspark import SparkConf

一, PyCharm搭建Spark开发环境 Windows7, Java 1.8.0_74, Scala 2.12.6, Spark 2.2.1, Hadoop 2.7.6 通常情况下,Spark开发是基于Linux集群的,但这里作为初学者并且囊中羞涩,还是在windows环境下先学习吧. 参照这个配置本地的Spark环境. 之后就是配置PyCharm用来开发Spark.本人在这里浪费了不少时间,因为百度出来的无非就以下两种方式: 1. 在程序中设置环境变量 import os import s

一.工具准备 1. jdk1.8 2. scala 3. anaconda3 4. spark-2.3.1-bin-hadoop2.7 5. hadoop-2.8.3 6. winutils 7. pycharm 二.安装 1. jdk安装 oracle官网下载,安装后配置JAVA_HOME.CLASS_PATH,bin目录追加到PATH,注意:win10环境下PATH最好使用绝对路径!下同! 2. scala安装 官网下载,安装后配置SCALA_HOME,bin目录追加到PATH(上图包含)

参考http://www.mamicode.com/info-detail-1523356.html1.远端执行:vi /etc/profile添加一行:PYTHONPATH=$SPARK_HOME/python/:$SPARK_HOME/python/lib/py4j-0.9-src.zip或者PYTHONPATH=$SPARK_HOME/python/:$SPARK_HOME/python/lib/py4j-0.8.2.1-src.zip2.安装pip 和 py4j下载pip-9.0.1.t

欢呼一下先.软件环境菜鸟的我终于把单机Spark 和 Pyspark 安装成功了.加油加油!!! 1. 安装方法参考: 已安装Pycharm 和 Intellij IDEA. win7 PySpark 安装: http://blog.csdn.net/a819825294/article/details/51782773 win7 Spark安装: http://blog.csdn.net/a819825294/article/details/51627083 2. 遇到的那些问题: 1) Sc

windows7 spark单机环境搭建 follow this link how to run apache spark on windows7 pycharm 访问本机 spark 安装py4j 配置pycharm 在PYTHON_HOME\lib\site-packages下新建pyspark.pth文件内容为: D:\program\spark-1.5.1-bin-hadoop2.4\python 试运行

准备: windows环境说明:Python2.7 + pipspark版本:spark-1.6.1-bin-hadoop2.6 step1: 下载并解压tar包到自定义的路径.(下载链接 https://d3kbcqa49mib13.cloudfront.net/spark-1.6.1-bin-hadoop2.6.tgz) step2:配置 %SPARK_HOME% 环境变量 step3:拷贝pyspark对应的python工具包到python的安装路径下 "%PYTHON%/site-pac

继续上篇的pyspark集成后,我们再来看看当今热的不得了的tensorflow是如何继承进pycharm环境的 参考: http://blog.csdn.net/include1224/article/details/53452824 思路其实很简单,说下要点吧 1. python必须要3.5 64位版本(上一篇直接装的是64位版本的Anaconda) 2. 激活3.5版本的python环境,用activate {env name}就行了 3. 在激活的环境中运行pip install --u

安装需要如下东西: java jdk-8u181-windows-x64.exe spark spark-2.1.3-bin-hadoop2.7 hadoop(版本要与spark的一致,这里都是hadoop2.7) hadoop-2.7.7 Anaconda(这个是为了预防python出现api-ms-win-crt-runtime-l1-1-0.dll错误,且安装了vc_redist.2015.exe还无法解决时需要安装) Anaconda3-2.4.1-Windows-x86_64.exe

一.单机版本Spark安装 Win10下安装Spark2.2.1 1. 工具准备 JDK 8u161 with NetBeans 8.2: http://www.oracle.com/technetwork/java/javase/downloads/jdk-netbeans-jsp-142931.html spark: spark-2.2.1-bin-hadoop2.7: https://spark.apache.org/downloads.html winutils.exe:下载的是针对ha

继续上篇的pyspark集成后,我们再来看看当今热的不得了的tensorflow是如何继承进pycharm环境的 参考: http://blog.csdn.net/include1224/article/details/53452824 思路其实很简单,说下要点吧 1. python必须要3.5 64位版本(上一篇直接装的是64位版本的Anaconda) 2. 激活3.5版本的python环境,用activate {env name}就行了 3. 在激活的环境中运行pip install --u

1.安装anaconda2 安装好之后,本地python环境就采用anaconda自带的python2.7的环境. 2.安装py4j 在本地ctrl+r打开控制台后,直接使用pip安装py4j,因为anaconda默认是安装了pip的,当然也可以使用conda安装. 安装命令:pip install py4j 如果不安装py4j可能出现的问题? 答:因为Spark的Python版本的API依赖于py4j,如果不安装运行程序会抛出如下错误. 3.配置环境变量 配置PyCharm的环境变

热门专题

相关文章

-

pyecharts kline版本

pyecharts kline版本

- 互联网

- 2026年06月03日

-

pyecharts绘制中国地图

pyecharts绘制中国地图

- 互联网

- 2026年06月03日

-

pyecharts可以画动的柱状图嘛

pyecharts可以画动的柱状图嘛

- 互联网

- 2026年06月03日

-

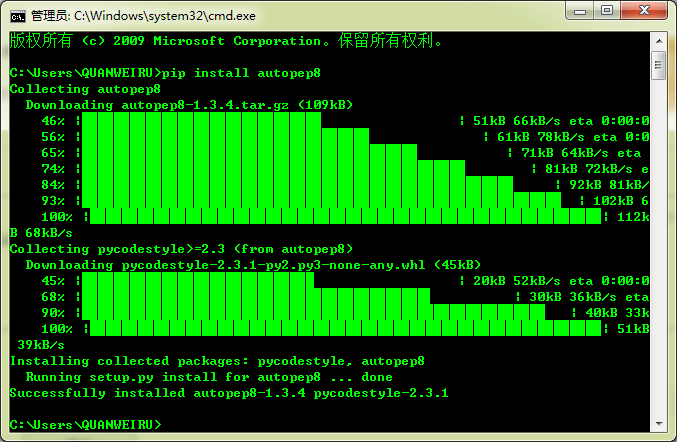

Pycharm配置autopep8让Python代码更符合pep8规范

Pycharm配置autopep8让Python代码更符合pep8规范

- 互联网

- 2026年06月03日

-

PyCharm+Eclipse共用Anaconda的数据科学环境

PyCharm+Eclipse共用Anaconda的数据科学环境

- 互联网

- 2026年06月03日

-

pycharm 主题下载

pycharm 主题下载

- 互联网

- 2026年06月03日