python爬虫 模拟登陆校园网

- 作者: 五速梦信息网

- 时间: 2026年06月03日 13:34

最近跟同学学习爬虫的时候看到网上有个帖子,好像是山大校园网不稳定,用py做了个模拟登陆很有趣,于是我走上了一条不归路.....

先上一张校园网截图

首先弄清一下模拟登陆的原理:

1:服务器判定浏览器登录使用浏览器标识,需要模拟登陆

2: 需要post账号,密码,以及学校id

python走起,我用的2.7版本,用notepad++写的,绑定python可以直接运行

由于是模拟网页登陆,需要导入urllib urllib2 cookielib库,前两个有与网页直接的接口,cookielib就是用来处理cookie的

先了解一下这几个库函数 一片不错的博客

http://www.cnblogs.com/mmix2009/p/3226775.html

ok,开始构建一个opener

用urllib2.HTTOCookieProcessor处理CookieJar获得的cookie,并被build_opener处理

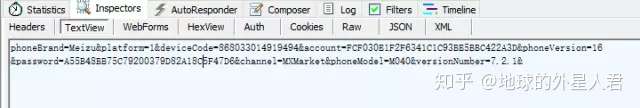

然后构建一下需要post的header,这个地址并不是我们输入账号密码的地址,而是提交数据被处理的地址,在登陆的时候用浏览器抓一下:

嗯 就是右边的那个URL,我们最后提交的网址就是那个。我们看一下他的header

差不多就这些,可以都写上,也可以只写服务器验证的UA等等

需要提交的数据:

然后就是post了,使用Requset(url,post_data,header)

再open(req)放到content里,print一下试试是否成功。

然后.....然后发现失败了找找bug.....

因为是学习的网上的,那个简单的例子只有用户名和密码,而这个登陆还要选择大学.......

好吧,那就先找下源码,结果没找到,就从header里找,果然在cookie里有个schoo id=XXXX,没错了,就是这个了,于是在data里再加上这个,结果提交了以后还是失败。最后发现提交的data里的userName,password,school_必须和request里的名称大小写下划线什么的要一致:

最终代码(账号密码什么的用XXXX代替了):

运行一下:

初步success~以后在深一步研究

还有求dalao解答我从notepad++上用#注释没效果咋回事......

------------------------------------------------------------------------------------------------------------------------------------

------------------------------------------------------------------------------------------------------------------------------------

学习了requests库 果然好用。。。贴一下代码

// 之前#没用是没保存成py格式直接运行了......

- 上一篇: Python爬虫:抓取手机APP的数据

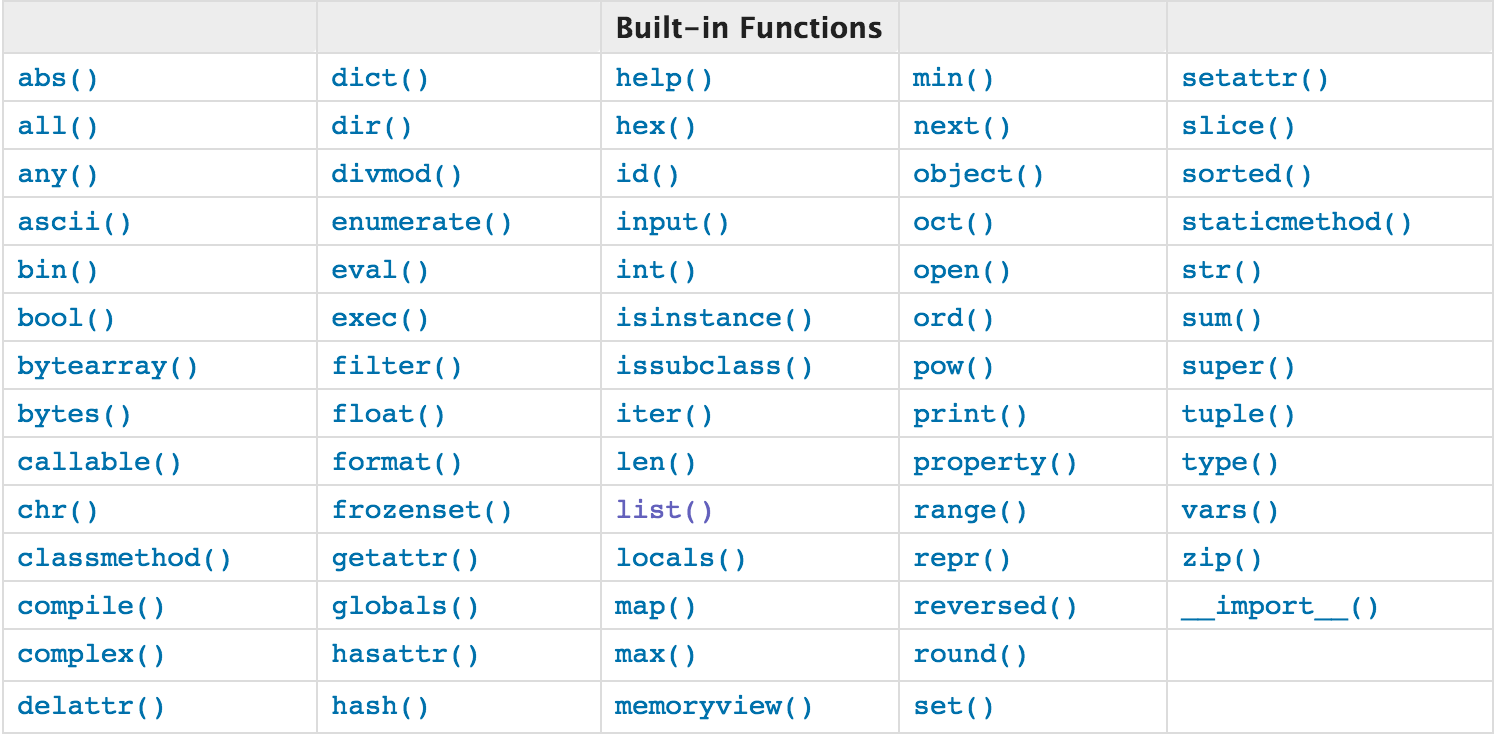

- 下一篇: python内置数据类型