蚂蚁集团发布两款MoE大模型,国产芯片训练成本大幅降低

- 作者: 五速梦信息网

- 时间: 2026年05月31日 12:41

突破硬件限制:蚂蚁集团推出高效低成本大模型

近年来,随着人工智能技术的飞速发展,大语言模型的训练需求不断攀升,但高昂的硬件成本和稀缺的高性能芯片资源成为一大瓶颈。近日,蚂蚁集团Ling团队在预印版Arxiv平台发表了一篇重要论文,宣布成功研发出两款不同规模的混合专家(MoE)大语言模型——百灵轻量版(Ling-Lite)与百灵增强版(Ling-Plus)。这一成果不仅实现了在低性能硬件上的高效训练,还显著降低了训练成本。

百灵轻量版参数规模为168亿(激活参数27.5亿),而增强版基座模型参数规模更是高达2900亿(激活参数288亿),其性能均达到行业领先水平。实验表明,这款3000亿参数的MoE大模型能够在国产GPU支持的低性能设备上完成高效训练,其性能与完全依赖英伟达芯片、同规模的稠密模型及MoE模型相当。这意味着,即使没有昂贵的高性能GPU,研究人员也能通过创新方法实现高质量的大模型训练。

创新策略:降低门槛,提升效率

当前,大多数MoE模型的训练依赖于英伟达H100/H800等高性能GPU,这不仅成本高昂,而且由于芯片短缺问题,进一步限制了这类模型在资源受限环境中的广泛应用。为了打破这一瓶颈,蚂蚁集团Ling团队提出了一系列创新策略,旨在“不使用高级GPU”扩展模型。

1.团队对架构与训练策略进行了革新,采用动态参数分配与混合精度调度技术,以优化计算资源的利用效率。2.他们升级了训练异常处理机制,引入自适应容错恢复系统,大幅缩短了中断响应时间,从而减少了因硬件故障或网络波动带来的损失。此外,团队还优化了模型评估流程,通过自动化评测框架将验证周期压缩超过50%,显著提升了整体训练效率。

值得一提的是,基于知识图谱的指令微调技术也被应用于复杂任务中,有效提升了模型在实际应用场景中的执行精度。这些创新方法共同构成了一个完整的解决方案,使得大模型训练不再局限于高端硬件配置。

经济性与性能兼备:低成本训练的可行性验证

为了验证这些创新方法的实际效果,Ling团队在五种不同的硬件配置下对9万亿个token进行了Ling-Plus的预训练。结果显示,在使用高性能硬件配置的情况下,训练1万亿token的预训练成本约为635万元人民币。然而,当采用蚂蚁优化方法后,在低规格硬件上的训练成本降至约508万元,节省近20%。更重要的是,这种低成本训练方式并未牺牲模型性能,其表现与阿里通义Qwen2.5-72B-Instruct和DeepSeek-V2.5-1210-Chat等顶尖模型相当。

此前,DeepSeek通过算法创新和工程优化,成功使用英伟达H800训练出了性能顶尖的V3与R1模型,为降低成本和提高效率开辟了新路径。而蚂蚁集团的技术成果如果能够得到更广泛的验证和推广,则将进一步推动国产大模型寻找更加经济高效的替代方案,包括国产芯片在内的多种选择,从而减少对英伟达芯片的过度依赖。

小编建议,这项研究成果不仅是技术上的突破,也为未来大模型的研发提供了新的思路。通过降低硬件门槛和训练成本,更多研究者和企业将有机会参与到这一领域中,共同推动人工智能技术的发展。

相关文章

-

蚂蚁集团11月6日启动退款程序 蚂蚁集团为什么不上市了 蚂蚁集团推迟上市原因

蚂蚁集团11月6日启动退款程序 蚂蚁集团为什么不上市了 蚂蚁集团推迟上市原因

- 互联网

- 2026年05月31日

-

蚂蚁集福2024赠送2000是真的吗

蚂蚁集福2024赠送2000是真的吗

- 互联网

- 2026年05月31日

-

蚂蚁花呗罚息减免条件

蚂蚁花呗罚息减免条件

- 互联网

- 2026年05月31日

-

蚂蚁集团回应支付宝重大事故

蚂蚁集团回应支付宝重大事故

- 互联网

- 2026年05月31日

-

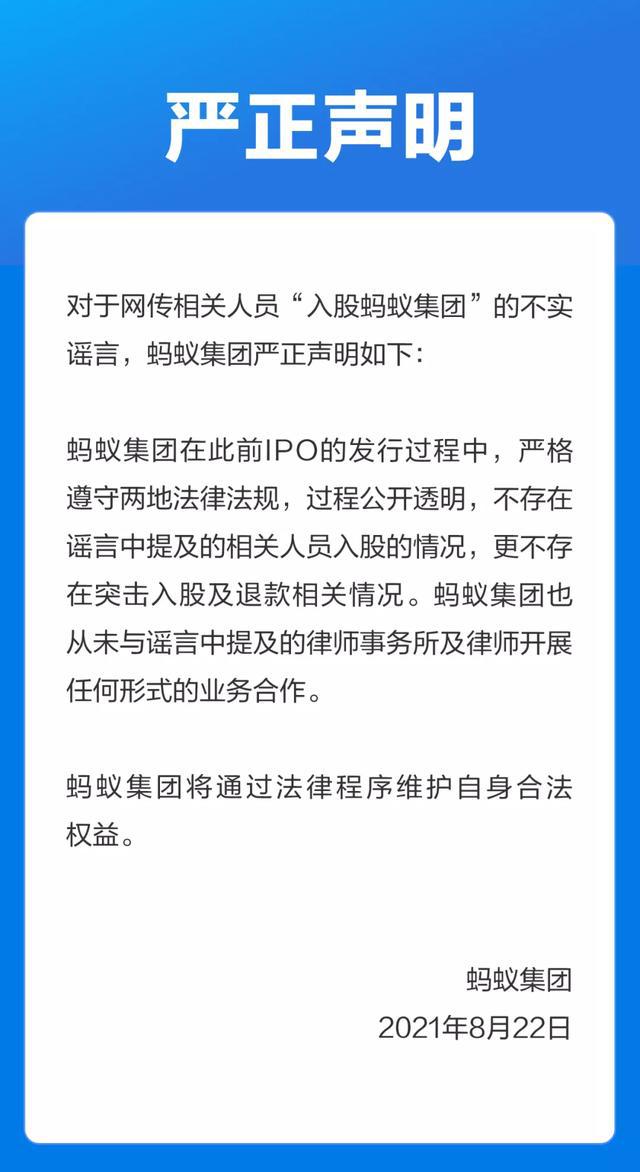

蚂蚁集团辟谣网传相关人员入股详情 蚂蚁集团最大股东是谁?

蚂蚁集团辟谣网传相关人员入股详情 蚂蚁集团最大股东是谁?

- 互联网

- 2026年05月31日

-

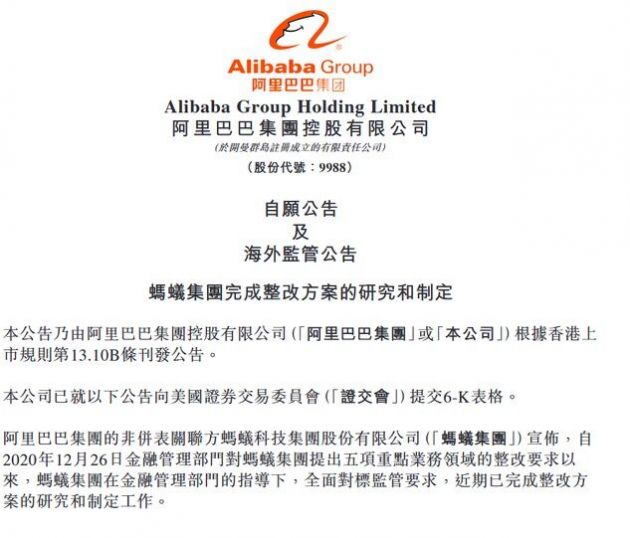

蚂蚁集团再被约谈回应 蚂蚁集团整体申设为金融控股公司

蚂蚁集团再被约谈回应 蚂蚁集团整体申设为金融控股公司

- 互联网

- 2026年05月31日