零基础搭建AI作曲工具:基于MagentaTensorFlow的交互式音乐生成系统

- 作者: 五速梦信息网

- 时间: 2026年03月21日 04:43

`统一序列长度

三、LSTM音乐生成模型训练

3.1 模型架构

import tensorflow as tf

from tensorflow.keras.layers import LSTM, Dense

def build_model(input_shape, num_notes):

model = tf.keras.Sequential([

LSTM(512, return_sequences=True, input_shape=input_shape),

LSTM(512),

Dense(num_notes, activation='softmax')

])

model.compile(loss='categorical_crossentropy', optimizer='adam')

return model

3.2 训练流程

- 数据加载:使用Magenta内置的钢琴MIDI数据集

- 序列生成:创建100个时间步长的输入-输出对

- 模型训练:

# 示例训练代码

model = build_model((100, 128), 128) # 假设128个音符类别

model.fit(X_train, y_train, epochs=50, batch_size=64)

四、风格迁移算法实现

4.1 风格特征提取

音高分布:统计各音级的出现频率

节奏模式:计算音符持续时间分布

和声走向:分析和弦进行规律

4.2 风格转换网络

def style_transfer(content_melody, style_features):

# 使用预训练的VAE模型进行风格编码

content_latent = encoder.predict(content_melody)

style_latent = style_encoder.predict(style_features)

# 混合潜在空间

mixed_latent = 0.7*content_latent + 0.3*style_latent

return decoder.predict(mixed_latent)

五、音频合成模块开发

5.1 MIDI生成

from midiutil import MIDIFile

def generate_midi(melody, filename):

track = 0

time = 0

midi = MIDIFile(1)

for note in melody:

pitch = note.pitch

duration = note.end_time - note.start_time

midi.addNote(track, channel, pitch, time, duration, volume)

time += duration

with open(filename, "wb") as output_file:

midi.writeFile(output_file)

5.2 音频渲染

# 使用FluidSynth进行MIDI转音频

fluidsynth -ni soundfont.sf2 input.mid -F output.wav -r 44100

六、交互式Web界面构建

6.1 后端API

from flask import Flask, request, send_file

app = Flask(__name__)

@app.route('/generate', methods=['POST'])

def generate_music():

style = request.json['style']

# 调用生成函数

midi_data = ai_composer.generate(style)

# 转换为WAV

audio_data = convert_midi_to_wav(midi_data)

return send_file(audio_data, mimetype='audio/wav')

if __name__ == '__main__':

app.run(debug=True)

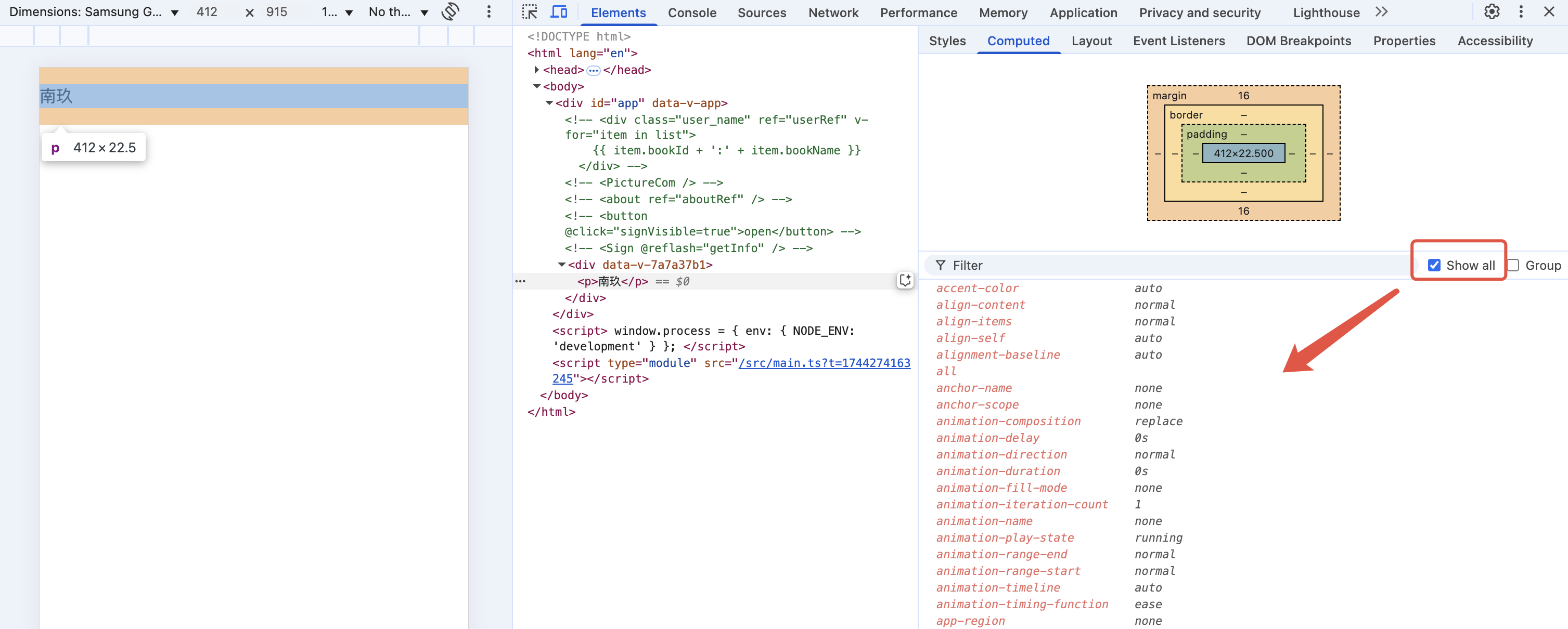

6.2 前端界面

七、系统优化与扩展

7.1 性能提升

使用GPU加速训练

采用混合精度训练

实现模型量化部署

7.2 功能扩展

添加多乐器支持

集成实时交互编辑

开发情绪感知生成

结语:AI作曲的未来图景

我们构建的不仅是音乐生成工具,更是通向AI创意的新窗口。当算法开始理解巴赫的赋格逻辑,当神经网络能捕捉德彪西的印象主义,音乐创作正进入人机协同的新纪元。这个5000字的教程只是起点,期待你在此基础上创造出更惊艳的AI音乐作品。 技术深度提示:在模型训练中尝试使用Transformer架构替代LSTM,可显著提升长程依赖建模能力;探索对抗训练(GAN)在音乐生成中的应用,能产生更具表现力的作品。

- 上一篇: 林于超个人资料(还有女明星活得这么卑微?)

- 下一篇: 刘芸资料(刘芸瘦了8斤更美)

相关文章

-

林于超个人资料(还有女明星活得这么卑微?)

林于超个人资料(还有女明星活得这么卑微?)

- 互联网

- 2026年03月21日

-

林黛玉最后的结局到底是什么?

林黛玉最后的结局到底是什么?

- 互联网

- 2026年03月21日

-

燎原小说:无广告且超百书源的免费阅读神器

燎原小说:无广告且超百书源的免费阅读神器

- 互联网

- 2026年03月21日

-

刘芸资料(刘芸瘦了8斤更美)

刘芸资料(刘芸瘦了8斤更美)

- 互联网

- 2026年03月21日

-

浏览器如何确定最终的CSS属性值?解析计算优先级与规则

浏览器如何确定最终的CSS属性值?解析计算优先级与规则

- 互联网

- 2026年03月21日

-

留学准备(留学,但不知道要准备些啥?)

留学准备(留学,但不知道要准备些啥?)

- 互联网

- 2026年03月21日