windows11 安装WSL2详细过程

- 作者: 五速梦信息网

- 时间: 2026年03月21日 04:38

mtu 1500

inet 172.28.255.140 netmask 255.255.240.0 broadcast 172.28.255.255

inet6 fe80::215:5dff:fe47:b74c prefixlen 64 scopeid 0x20<link/>

ether 00:15:5d:47:b7:4c txqueuelen 1000 (Ethernet)

RX packets 2712288 bytes 4101955783 (4.1 GB)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 275004 bytes 21708764 (21.7 MB)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

注意:这个ip,Windows11是可以直接通讯的。所以你使用xshell客户端,也是可以连接的。

# 四、安装英伟达显卡驱动

我的游戏本,英伟达显卡型号是,NVIDIA GeForce RTX 5080 Laptop GPU,显存有16GB

内存有64GB,已经顶级配置了,因为主板最大只能支持64GB

固态硬盘2TB,也接近顶级了,因为主板只有2个硬盘插槽。

cpu是Intel Core i9 14900HX,是英特尔移动端性能比较高的cpu。

## CUDA Toolkit

CUDA Toolkit 是NVIDIA 提供的一套开发工具,它包含了用于开发CUDA 应用程序所需的各种工具,如编译器、调试器和库。 因此,CUDA 和CUDA Toolkit 是有关系的,CUDA 是并行计算平台和编程模型,而CUDA Toolkit 是一套开发工具。

如果你想在 WSL 中使用 CUDA Toolkit,可以按照以下步骤进行安装:

1. 在 NVIDIA 官网找到与你的显卡和驱动程序兼容的 CUDA Toolkit 版本。

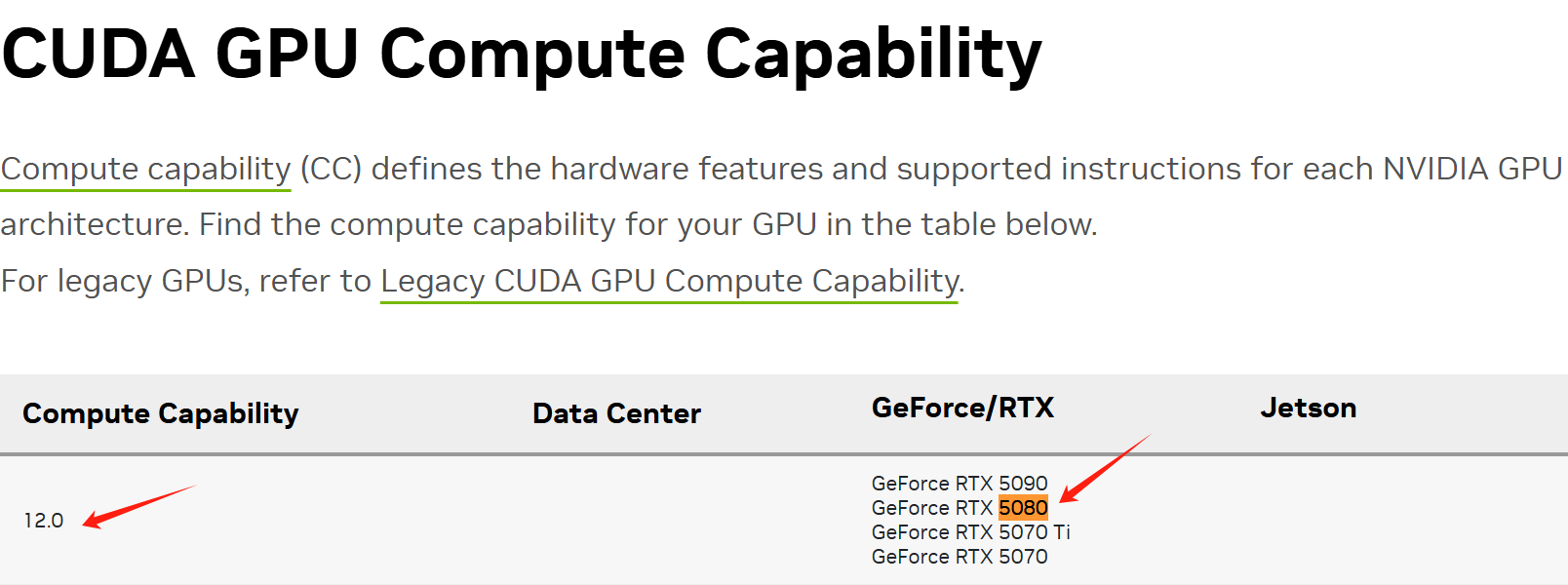

### 查看显卡算力

https://developer.nvidia.com/cuda-gpus

我的显卡是5080,对应的显卡算力是12.0

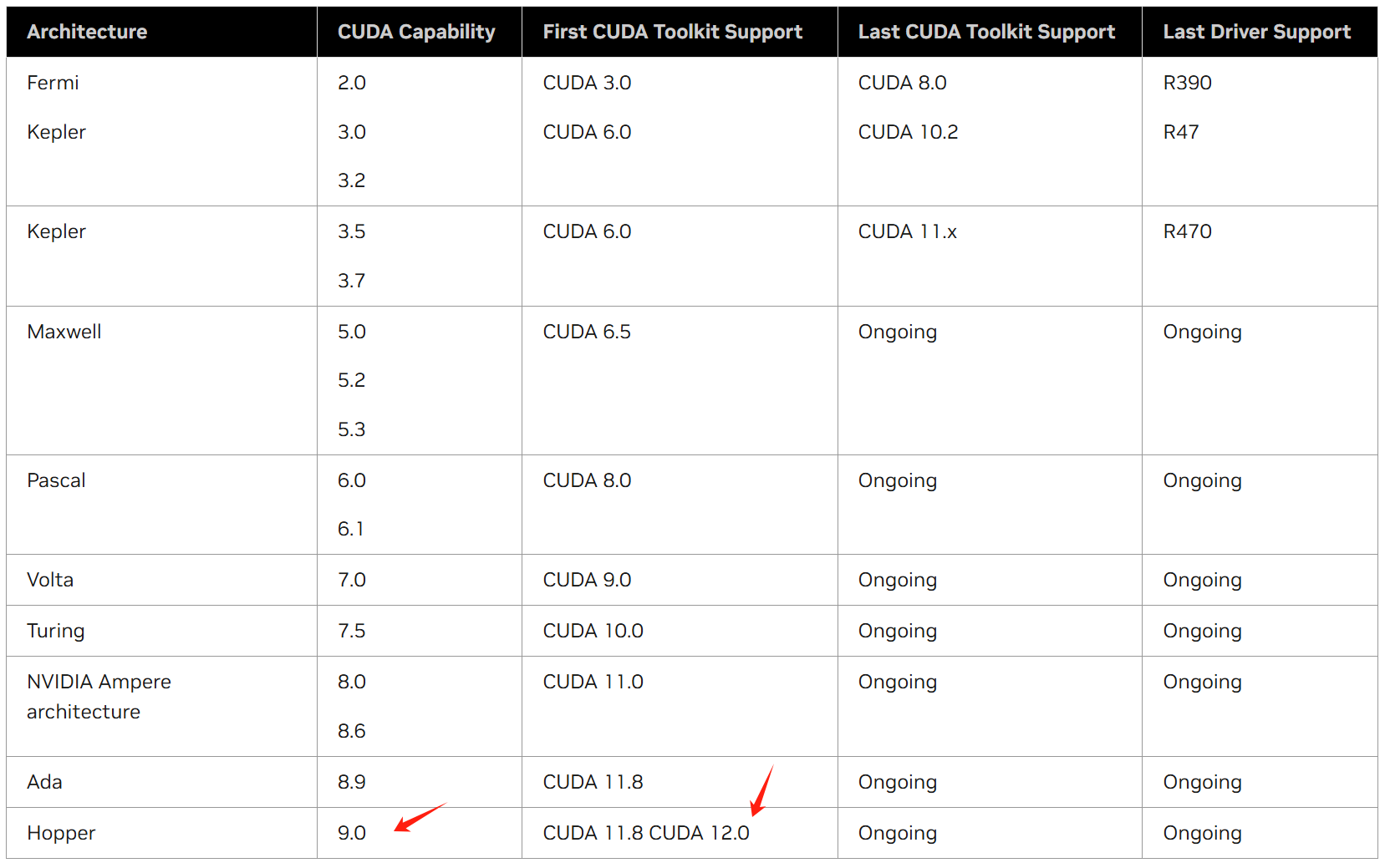

### 算力对应的cuda版本

https://docs.nvidia.com/datacenter/tesla/drivers/index.html#cuda-arch-matrix

我的显卡算力是12,大于9,所以可以安装CUDA 11.8 CUDA 12.0,都可以。

**注意:只能高,不能低。**

2. 在 WSL 的 Ubuntu 终端中安装 CUDA Toolkit。例如,安装 CUDA Toolkit 12.8:

```csharp

wget https://developer.download.nvidia.com/compute/cuda/repos/wsl-ubuntu/x86_64/cuda-wsl-ubuntu.pin

sudo mv cuda-wsl-ubuntu.pin /etc/apt/preferences.d/cuda-repository-pin-600

wget https://developer.download.nvidia.com/compute/cuda/12.8.0/local_installers/cuda-repo-wsl-ubuntu-12-8-local_12.8.0-1_amd64.deb

sudo dpkg -i cuda-repo-wsl-ubuntu-12-8-local_12.8.0-1_amd64.deb

sudo cp /var/cuda-repo-wsl-ubuntu-12-8-local/cuda-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cuda-toolkit-12-8

- 将 CUDA 工具链添加到环境变量中:

echo 'export PATH=/usr/local/cuda/bin:$PATH' >> ~/.bashrc

echo 'export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH' >> ~/.bashrc

source ~/.bashrc

- 验证 CUDA Toolkit 运行以下命令验证 CUDA Toolkit 是否安装成功:

# nvcc -V

nvcc: NVIDIA (R) Cuda compiler driver

Copyright (c) 2005-2025 NVIDIA Corporation

Built on Wed_Jan_15_19:20:09_PST_2025

Cuda compilation tools, release 12.8, V12.8.61

Build cuda_12.8.r12.8/compiler.35404655_0

NVIDIA 驱动程序

在 WSL 的 Ubuntu 终端中运行以下命令,安装与你的显卡兼容的 NVIDIA 驱动程序。例如,安装最新的驱动程序版本:

sudo apt install nvidia-utils-570-server

安装完成后,运行以下命令验证 NVIDIA 驱动程序是否正确安装:

nvidia-smi

效果如下:

# nvidia-smi

Wed May 7 15:19:11 2025

+-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 570.133.20 Driver Version: 576.28 CUDA Version: 12.9 |

|-----------------------------------------+------------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA GeForce RTX 5080 ... On | 00000000:01:00.0 On | N/A |

| N/A 45C P5 28W / 100W | 1870MiB / 16303MiB | 5% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

+-----------------------------------------------------------------------------------------+

| Processes: |

| GPU GI CI PID Type Process name GPU Memory |

| ID ID Usage |

|=========================================================================================|

| No running processes found |

+-----------------------------------------------------------------------------------------+

可以看到显卡NVIDIA GeForce RTX 5080,显存为16303MiB,也就是16GB

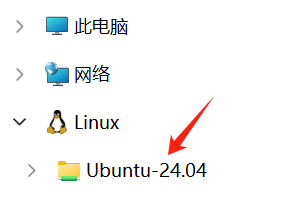

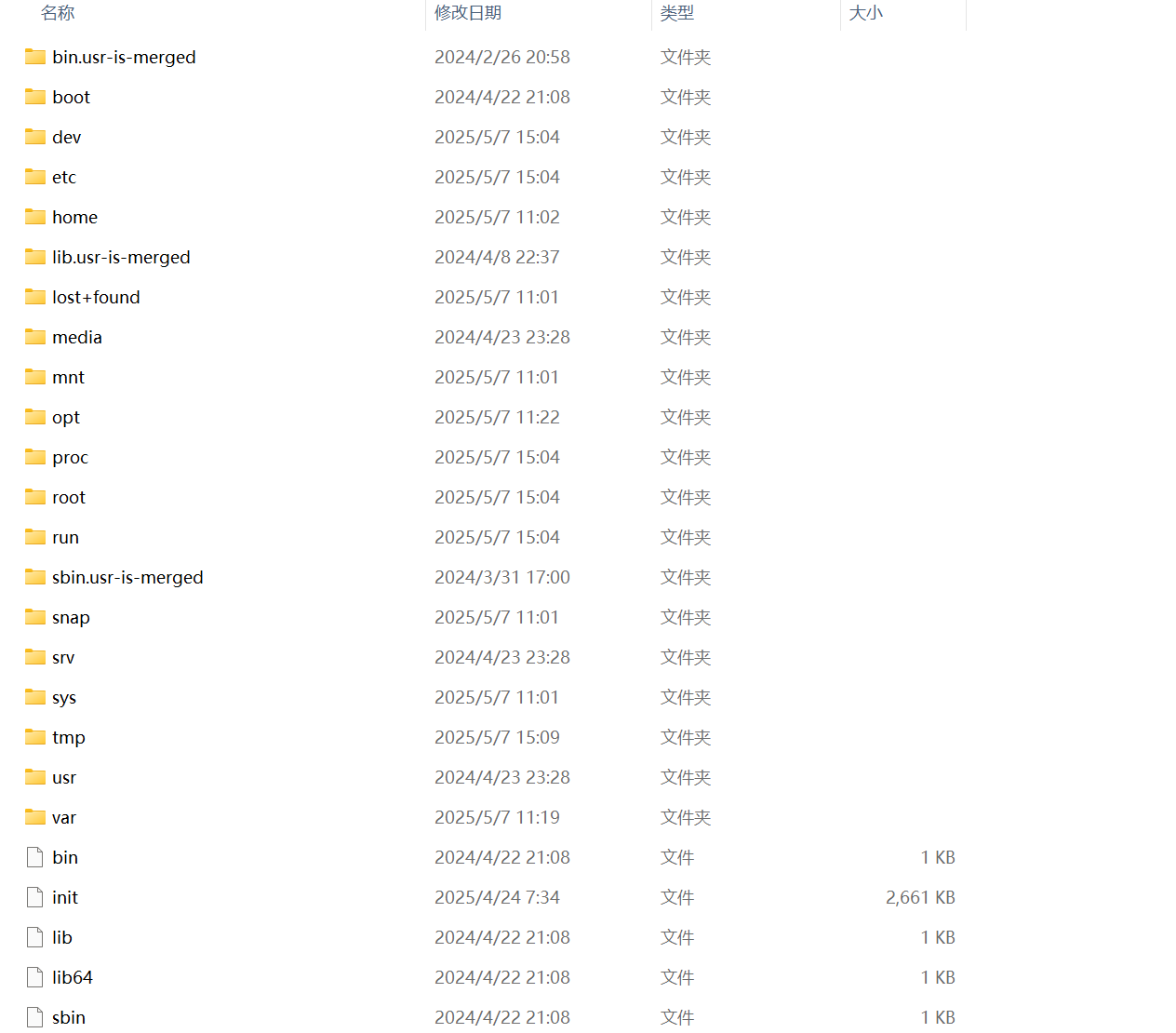

五、WSL文件管理

Ubuntu运行成功之后,可以看到一个小企鹅图标,点击进去

这里可以看到Linux文件

这里可以看到Linux文件

注意:某些目录是不允许访问的。

如果你需要上传文件,可以上传到tmp目录,是可以的。

你也可以通过xftp工具进行上传也没问题。

进入本地目录,D:\Ubuntu_2404.0.5.0_x64,可以看到文件ext4.vhdx

注意:某些目录是不允许访问的。

如果你需要上传文件,可以上传到tmp目录,是可以的。

你也可以通过xftp工具进行上传也没问题。

进入本地目录,D:\Ubuntu_2404.0.5.0_x64,可以看到文件ext4.vhdx

上面展示的Linux文件系统的文件,都在这个硬盘文件里面,目前有18.6GB。

之后产生的所有文件,都在这里。

上面展示的Linux文件系统的文件,都在这个硬盘文件里面,目前有18.6GB。

之后产生的所有文件,都在这里。

六、Anaconda安装

Anaconda是一个开源的Python发行版本,专注于数据科学、机器学习和大数据处理,集成了conda包管理器、Python解释器及180多个预装科学计算库(如NumPy、Pandas),提供跨平台的环境隔离与管理功能。 其实说白了,就是方便创建python虚拟环境。因为ubuntu24.04系统,默认就有一个python环境,但是这套系统,可能要运行多个python项目,比如:api server,定时脚本,AI大模型等等。每个项目需要的组件是不一样的,一般都会为每一个项目,创建单独的虚拟环境,进行运行。

- 下载 Anaconda 安装脚本: 打开终端并输入以下命令下载最新版本的 Anaconda 安装脚本:

cd /tmp

wget https://repo.anaconda.com/archive/Anaconda3-2024.10-1-Linux-x86_64.sh

- 运行安装脚本: 使用 bash 命令运行下载的安装脚本:

bash Anaconda3-2024.10-1-Linux-x86_64.sh

在安装过程中,按提示操作,查看并同意许可协议,选择安装位置,一路yes完,选择默认配置即可,等待安装完成。

- 初始化 Conda: 安装完成后,运行以下命令初始化 Conda:

source ~/.bashrc

- 验证安装: 运行以下命令验证 Conda 是否安装成功:

conda --version

七、PyTorch安装

在进行 AI 模型微调过程中,只需要安装 CUDA Toolkit 即可满足基本需求。 在实际操作中,还需要确保安装的 CUDA Toolkit 版本与所使用的深度学习框架(如 TensorFlow、PyTorch 等)以及 GPU 驱动版本相互兼容。 例如,PyTorch 版本与 CUDA 版本必须要对应,否则无法正常使用 GPU 加速功能

安装命令

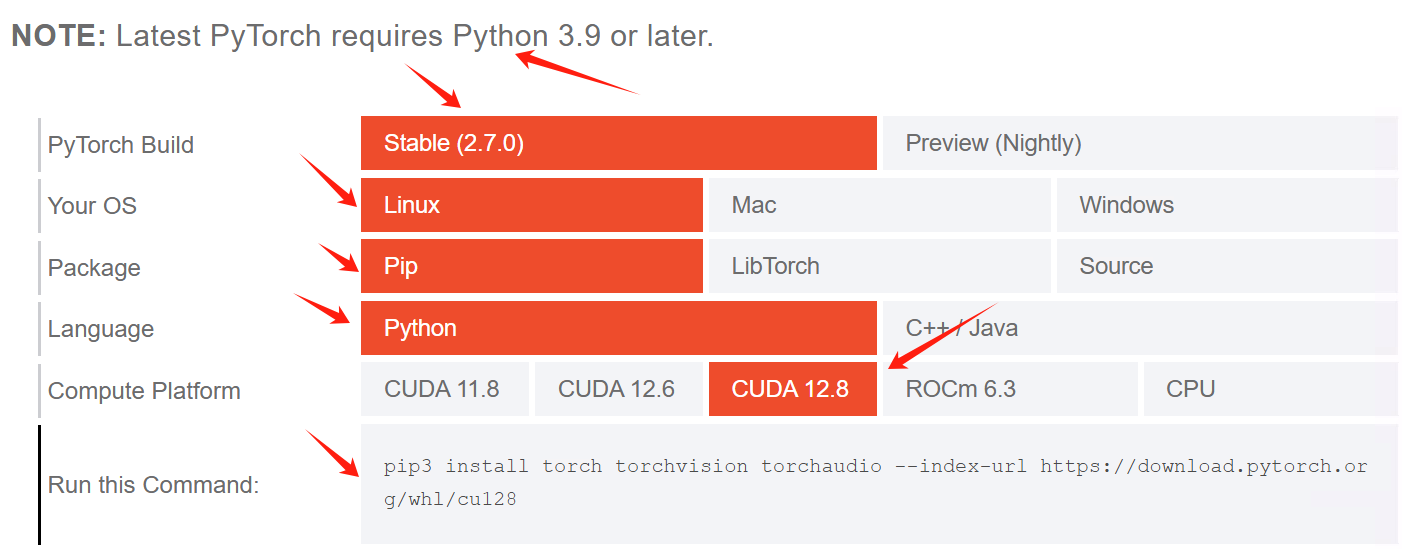

打开pytorch网页

https://pytorch.org/get-started/locally/

说明:

pytorch安装,python版本不能低于3.9

pytorch build,这里选择最新版本

your os,选择Linux

Package,选择pip安装

Language,开发语言,选择Python

compute platform,这里选择CUDA 12.8,因为在上面的步骤中,我安装的版本就是CUDA Toolkit 12.8

run this command,这里就会显示完整的安装命令,直接复制即可

说明:

pytorch安装,python版本不能低于3.9

pytorch build,这里选择最新版本

your os,选择Linux

Package,选择pip安装

Language,开发语言,选择Python

compute platform,这里选择CUDA 12.8,因为在上面的步骤中,我安装的版本就是CUDA Toolkit 12.8

run this command,这里就会显示完整的安装命令,直接复制即可

创建虚拟环境

使用conda创建虚拟python环境 默认ubuntu 24.04,python版本为3.12.7

conda create --name my_unsloth_env python=3.12.7

激活虚拟环境

conda activate my_unsloth_env

安装pytorch

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu128

在python中确认一下torch是否安装成功

# python

Python 3.12.7 | packaged by Anaconda, Inc. | (main, Oct 4 2024, 13:27:36) [GCC 11.2.0] on linux

Type "help", "copyright", "credits" or "license" for more information.

>>> import torch

>>> print(torch.cuda.device_count())

1

>>> print(torch.cuda.is_available())

True

>>> print(torch.__version__)

2.7.0+cu128

>>> print(torch.version.cuda)

12.8

>>> exit()

注意:确保torch.version.cuda输出的版本和CUDA Toolkit版本一致,就说明cuda和troch版本是匹配的。 AI大模型,需要的微调环境,基本上就安装完毕了。 主要涉及,CUDA Toolkit,NVIDIA 驱动程序,PyTorch 最后说明一下,WSL官方是不建议在生产环境中使用的,因为不稳定。 当然,我在使用过程中,也确实遇到了卡死情况。卡死了,怎么办?直接把cmd窗口关闭即可。 想要再次启动,直接运行D:\Ubuntu_2404.0.5.0_x64里面的ubuntu2404.exe文件即可。 WSL可以本地运行ubuntu系统,方便我们学习AI模型微调。在真正的生产环境中,是用Ubuntu服务器,直接加载服务器级别的显卡进行运算的。 当然,显卡价格是贵的离谱,一般都是公司买单。几十万,上百万的都有。

相关文章

-

WinDebug查看C#程序运行内存中的数据库连接字符串

WinDebug查看C#程序运行内存中的数据库连接字符串

- 互联网

- 2026年03月21日

-

win10系统怎么做备份(win10家庭版系统备份)

win10系统怎么做备份(win10家庭版系统备份)

- 互联网

- 2026年03月21日

-

WePush 一款基于模拟点击实现的微信消息推送机器人,安全稳定不封号

WePush 一款基于模拟点击实现的微信消息推送机器人,安全稳定不封号

- 互联网

- 2026年03月21日

-

Windows操作系统安装经验总结

Windows操作系统安装经验总结

- 互联网

- 2026年03月21日

-

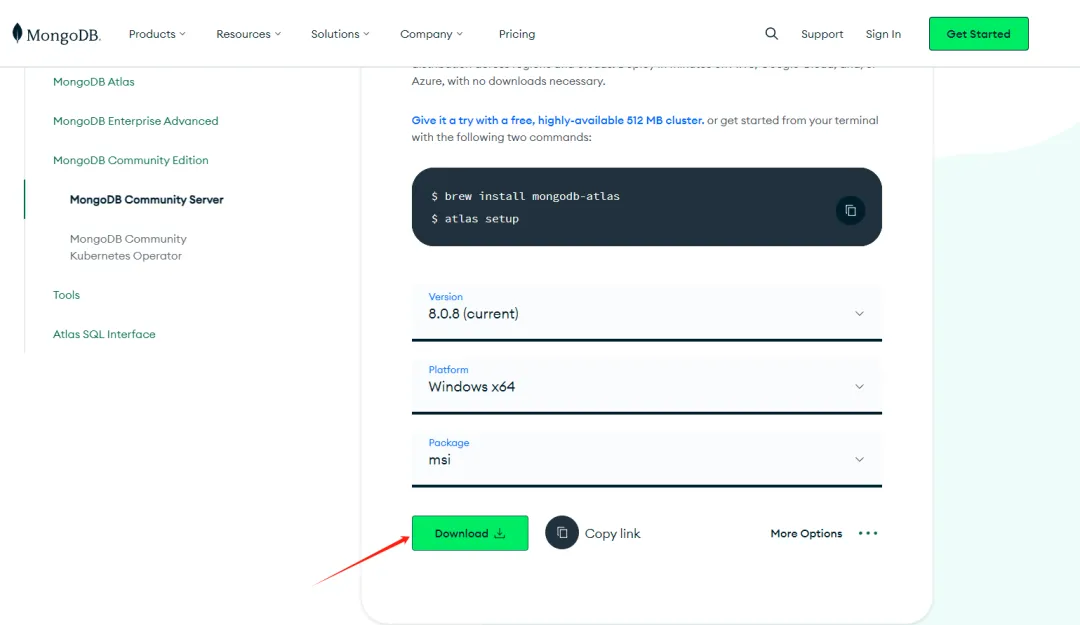

Windows快速安装MongoDB之Mongo实战

Windows快速安装MongoDB之Mongo实战

- 互联网

- 2026年03月21日

-

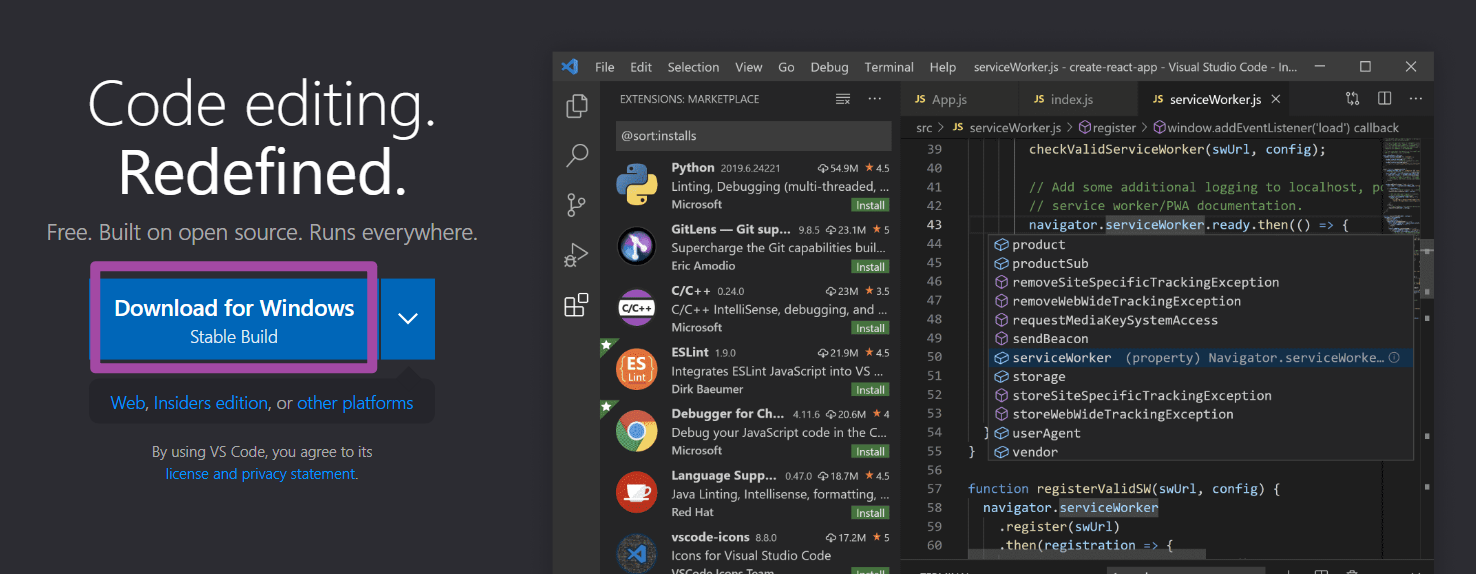

Windows配置VS Code详细流程

Windows配置VS Code详细流程

- 互联网

- 2026年03月21日